En el vertiginoso mundo de la realidad mixta (MR) y la realidad aumentada (AR), los sensores biométricos integrados están marcando un antes y un después. Estas tecnologías innovadoras capturan datos fisiológicos en tiempo real, como el ritmo cardíaco o los movimientos oculares, para ofrecer experiencias personalizadas que se adaptan al usuario al instante. Imagina simulaciones médicas que ajustan su dificultad según tu estrés o concentración: eso es el futuro que ya está aquí en 2025. Si buscas lo último sobre sensores biométricos en AR y MR, esta nota te detalla las tendencias, avances y aplicaciones prácticas.

¿Qué Son los Sensores Biométricos Integrados en MR y AR?

Los sensores biométricos integrados son componentes compactos embebidos en dispositivos como gafas inteligentes, visores de MR o lentes de contacto AR. Estos sensores miden parámetros biológicos clave sin interrupciones, fusionando datos del mundo físico con entornos virtuales. En 2025, su integración ha evolucionado gracias a avances en hardware inmersivo, como sistemas de seguimiento ocular y retroalimentación táctil, que amplifican la inmersión en ecosistemas de realidad extendida (XR).

- Tipos principales: Sensores infrarrojos para mapeo ocular, cámaras estereoscópicas que capturan hasta 120 imágenes por segundo y detectores de vibraciones cardíacas.

- Ventaja clave: Adaptan la experiencia en tiempo real, reduciendo la latencia y mejorando la precisión en un 94% en escenarios médicos.

Estos dispositivos no solo «leen» tu cuerpo, sino que responden, creando interacciones fluidas y personalizadas.

Novedades en Sensores Biométricos para AR y MR en 2025

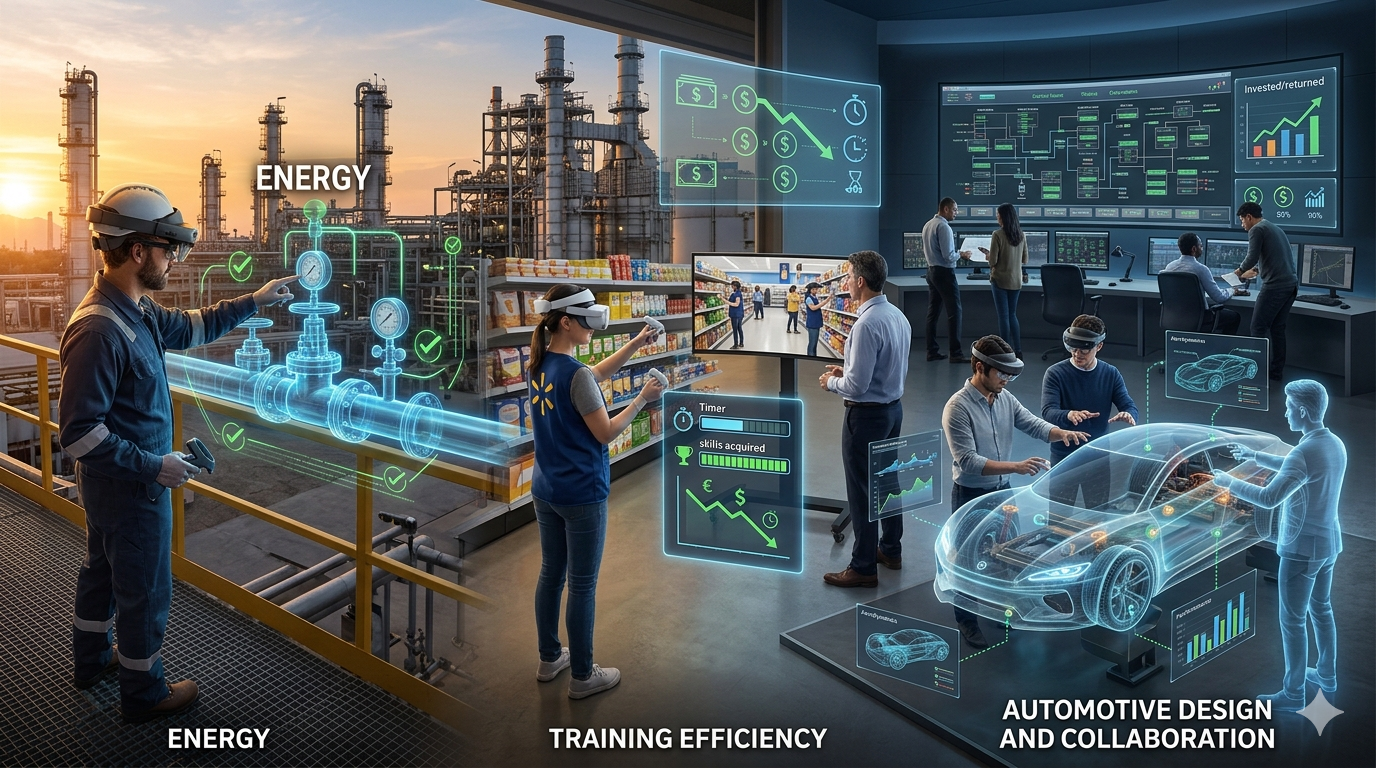

El año 2025 ha sido pivotal para los sensores biométricos en realidad aumentada y mixta, con innovaciones presentadas en eventos como CES 2025 y prototipos de Sony para profesionales. Según expertos, el enfoque está en hardware más ligero y conectividad inalámbrica de baja latencia, permitiendo una integración seamless en gafas AR como las Ray-Ban Meta 2 o Microsoft HoloLens 2.

- Prototipos destacados: Lentes de contacto inteligentes que miden glucosa o presión intraocular cada 2 segundos, combinados con interfaces holográficas para AR ocular.

- Avances en seguimiento: Sistemas que analizan micro-movimientos oculares con precisión de 5 micras, ideales para renderizado adaptativo.

- Tendencia emergente: Interfaces neuronales no invasivas que fusionan datos biométricos con audio espacial y baterías de mayor duración.

Estos desarrollos, impulsados por empresas como Unity y Sony, posicionan a los sensores biométricos como el núcleo de la tecnología inmersiva 2025, transformando desde el entretenimiento hasta la salud.

Cómo Capturan Datos: Ritmo Cardíaco y Movimientos Oculares en Acción

La magia de los sensores biométricos integrados radica en su capacidad para recolectar datos fisiológicos de forma no invasiva. En dispositivos AR/MR, estos sensores procesan información en edge computing, minimizando la dependencia de servidores externos.

- Ritmo cardíaco: Sensores de vibración detectan pulsos a través de la piel o arneses, ajustando entornos virtuales si detectan estrés (por ejemplo, pausando una simulación si el pulso supera 100 lpm).

- Movimientos oculares: Cámaras infrarrojas y estereoscópicas rastrean saccades (movimientos rápidos) y fijaciones, capturando hasta 120 puntos de datos por segundo para mapear atención y fatiga.

- Otros datos: Temperatura cutánea, patrones vasculares y hasta escaneos retinianos en tiempo real.

En plataformas como VisionAR Therapy, estos datos se analizan contra bases globales para predecir respuestas, como explica la Dra. Clara Méndez: «Nuestros algoritmos predicen qué ejercicios generarán mayor impacto según historial clínico y respuestas fisiológicas».

Experiencias Personalizadas: Simulaciones Médicas que Ajustan Dificultad en Tiempo Real

Una de las aplicaciones más revolucionarias de los sensores biométricos en MR y AR son las simulaciones médicas personalizadas. Aquí, los datos biométricos guían la narrativa virtual, ajustando la complejidad al estado del usuario para maximizar el aprendizaje y la seguridad.

- Ejemplo en cirugía: En EyeTrainAR, estudiantes practican procedimientos con retroalimentación basada en movimientos oculares; si la concentración baja (detectada por dilatación pupilar), la simulación simplifica el modelo 3D, reduciendo errores en un 38% según estudios del Johns Hopkins Hospital.

- Rehabilitación visual: Para pacientes con ambliopía, juegos AR ajustan desafíos según el ritmo cardíaco y el seguimiento ocular, mejorando la percepción de profundidad en sesiones postquirúrgicas.

- Entrenamiento profesional: Cirujanos usan MR con sensores que adaptan escenarios virtuales en tiempo real, proyectando mapas personalizados con márgenes de error de solo 3 micras.

Estas experiencias personalizadas en AR y MR no solo elevan la efectividad, sino que democratizan el acceso a entrenamientos de élite, desde hospitales hasta hogares.

Beneficios y el Futuro de los Sensores Biométricos en 2025

Los sensores biométricos integrados ofrecen precisión diagnóstica superior, reducción de costos en formación médica y mayor accesibilidad en realidad aumentada. En 2025, su impacto se extiende al metaverso, donde entornos adaptativos combaten el «síndrome de fatiga virtual».

- Beneficios clave: Mejora del 94% en precisión, inmersión táctil y privacidad de datos mediante procesamiento local.

- Desafíos: Ética en el manejo de datos biométricos y accesibilidad para usuarios con discapacidades.

- Pronóstico: Para 2026, espera implantes retinianos AR con sensores neuronales, fusionando MR con biotecnología.

Si estás explorando sensores biométricos en AR y MR, 2025 es el momento ideal para invertir en estas tecnologías. ¿Listo para una experiencia personalizada? Comparte tus pensamientos en los comentarios o suscríbete para más actualizaciones sobre realidad mixta y aumentada.

Bio1 año ago

Bio1 año ago

EmpresasTech5 meses ago

EmpresasTech5 meses ago

Researchland1 año ago

Researchland1 año ago

AI1 año ago

AI1 año ago

Nano1 año ago

Nano1 año ago

AI5 meses ago

AI5 meses ago

AI1 año ago

AI1 año ago

AI1 año ago

AI1 año ago