Introducción

La tecnología de proyección retiniana está a punto de dar un salto cualitativo que podría transformar radicalmente nuestra experiencia con dispositivos de realidad virtual y aumentada, así como revolucionar los sistemas de visualización en automóviles. AllFocal Optics, una startup británica con sede en Cambridge, ha desarrollado una innovadora tecnología de lentes nanofotónicas que proyecta imágenes directamente en la retina del usuario, ofreciendo una claridad visual sin precedentes y solucionando problemas fundamentales que han limitado la adopción masiva de estas tecnologías.

Con una reciente financiación de 5,3 millones de dólares y un equipo liderado por expertos provenientes de gigantes tecnológicos como Meta y Microsoft, AllFocal Optics está posicionada para redefinir cómo interactuamos con la información visual en entornos digitales y reales. Este artículo explora en profundidad esta tecnología disruptiva, sus aplicaciones potenciales y el impacto que podría tener en múltiples industrias.

La Tecnología de Proyección Retiniana: Fundamentos y Avances

¿Qué es la proyección retiniana?

La proyección retiniana es una tecnología que, como su nombre indica, proyecta imágenes directamente en la retina del ojo humano. A diferencia de las pantallas convencionales, que emiten luz que debe atravesar el sistema óptico del ojo (córnea, cristalino) antes de llegar a la retina, la proyección retiniana envía la información visual directamente a los fotorreceptores retinianos.

Según el artículo publicado en Wired el 27 de mayo de 2025, la tecnología desarrollada por AllFocal Optics «no tiene ninguna pantalla fija o virtual, así que nuestra imagen siempre está enfocada. Creamos una imagen proyectada en la retina… similar a la tecnología de proyección retiniana. Así que ahora el vínculo entre vergencia y acomodación está desacoplado», explica el Dr. Pawan Shrestha, fundador de la compañía y antiguo miembro de la Real Academia de Ingeniería.

La innovación de AllFocal Optics

Lo que distingue a AllFocal Optics de otros intentos previos en este campo es su capacidad para hacer comercialmente viable esta tecnología mediante lentes nanofotónicas ultradelgadas. Como detalla Real o Virtual en su artículo del 7 de noviembre de 2024, «la nanofotónica estudia las interacciones entre materia y luz a una escala más pequeña que la longitud de onda de la luz, y dominando esta tecnología, es posible la creación de materiales ensamblados casi átomo a átomo. Aplicado a la fabricación de lentes XR, su grosor sería mínimo, su claridad absoluta y las imágenes permanecerían siempre enfocadas.»

La tecnología de AllFocal Optics ofrece dos avances fundamentales:

1.Visión cristalina independiente de la graduación óptica del usuario: La lente transmite imágenes nítidas directamente a la retina, evitando por completo la necesidad de gafas correctoras, incluso para personas con astigmatismo o graduaciones importantes.

2.Eliminación del conflicto vergencia-acomodación: Este conflicto, que ocurre cuando nuestros ojos intentan enfocar a una distancia mientras convergen a otra, es la principal causa de mareos y fatiga visual en dispositivos VR/AR actuales.

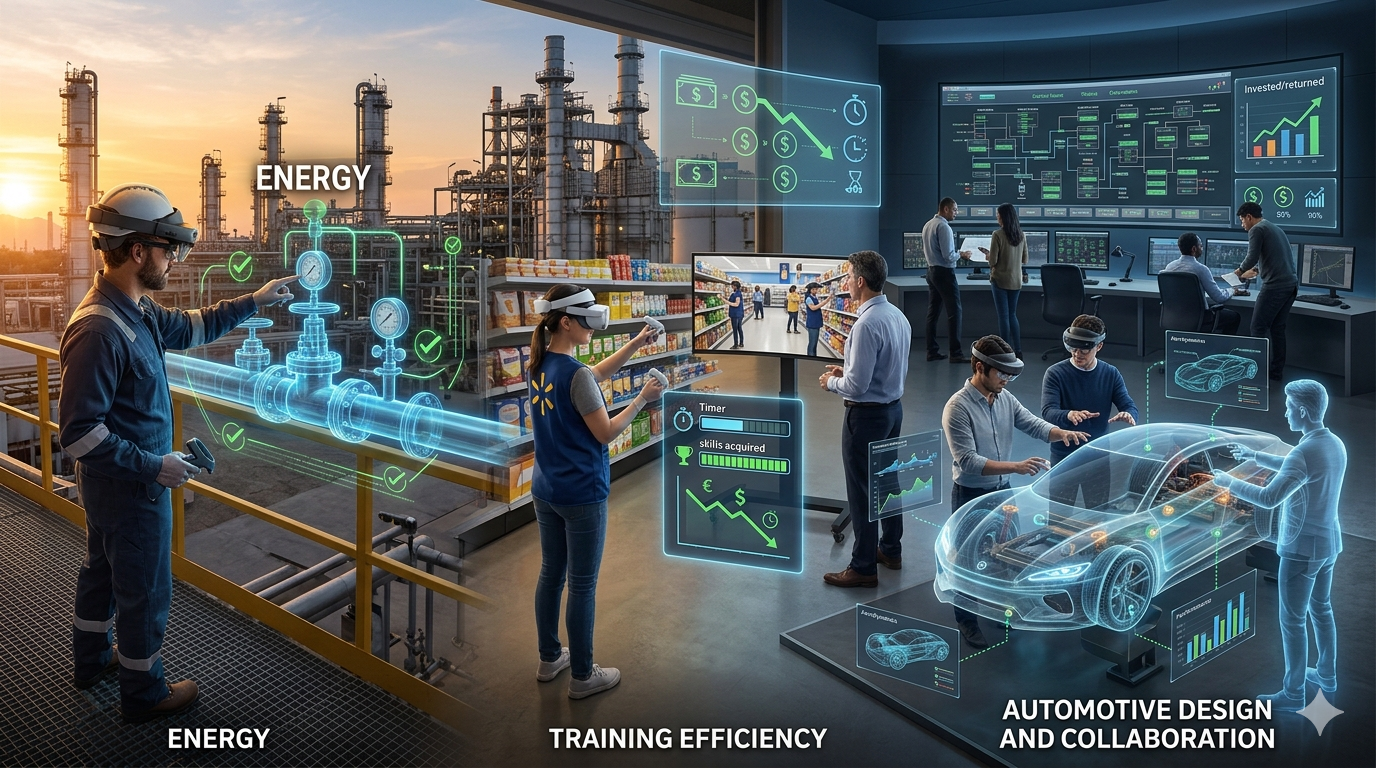

Aplicaciones en Realidad Virtual y Aumentada

Superando las limitaciones actuales

Los dispositivos de realidad virtual y aumentada actuales, como el Apple Vision Pro o el Meta Quest 3, enfrentan varios desafíos que limitan su adopción masiva y uso prolongado. Entre ellos destacan:

•La necesidad de usar gafas correctoras dentro del visor o insertos ópticos especiales

•La fatiga visual y mareos causados por el conflicto vergencia-acomodación

•La limitada nitidez de las imágenes, especialmente para textos y detalles finos

La tecnología de AllFocal Optics aborda directamente estos problemas. Como demostró el periodista de Wired durante su prueba con un prototipo: «He probado varios prototipos de la lente y, efectivamente, funciona. No llevo gafas, así que la primera demostración –ver texto digital transmitido desde un portátil a unas gafas de realidad aumentada– no me pareció demasiado impresionante. Pero luego repetí la prueba con unas gafas tan potentes que no podía verme las manos delante de la cara, y el texto digital seguía siendo nítido como un alfiler.»

Comparativa con tecnologías existentes

En comparación directa con dispositivos establecidos, la tecnología de AllFocal Optics muestra ventajas significativas. Según Wired, «la lente no solo evita los problemas de visión, sino que también produce una imagen mucho más nítida que las HoloLens de Microsoft, a pesar de que la entrada tiene la misma resolución de 720p.»

Además, la tecnología mantiene la nitidez independientemente de dónde enfoque el usuario: «Experimenté enfocando primero mi mano a pocos centímetros de mi cara y luego al otro lado de la habitación, pero el texto aumentado seguía enfocado. Curiosamente, su tamaño se ajusta en función de hacia dónde se mire; podía hacer que apareciera como una fuente diminuta en mi dedo, o como una escritura del tamaño de un póster en la pared de enfrente.»

Revolución en los Head-Up Displays de Automóviles

Mejorando la seguridad vial

Una de las aplicaciones más prometedoras de esta tecnología se encuentra en los head-up displays (HUD) de los automóviles. Estos sistemas, que proyectan información relevante como velocidad, navegación o alertas en el parabrisas, permiten al conductor mantener la vista en la carretera mientras consulta datos importantes.

Sin embargo, los HUD actuales presentan limitaciones significativas, especialmente para conductores con problemas de visión. La tecnología de AllFocal Optics podría transformar radicalmente este campo.

Como señala Real o Virtual, la empresa «ya tiene resultados, como un HUD integrado en los parabrisas de vehículos Jaguar-Land Rover, listos para someterse a pruebas a principios del año que viene.» Este desarrollo no es meramente teórico, sino que ya está en fase avanzada de implementación con un fabricante de automóviles de primer nivel.

Ventajas para la conducción

El Dr. Shrestha explica en Wired las ventajas específicas para la conducción: «En lugar de cambiar el enfoque entre la interfaz proyectada y la carretera, todo lo que hay que hacer es cambiar la atención, y eso requiere un tiempo de reacción casi nulo. Puedes cambiar de contexto sin tener que desplazar mecánicamente la lente ocular.»

Esta capacidad para mantener todo en foco simultáneamente podría reducir significativamente el tiempo de reacción de los conductores ante situaciones de emergencia, mejorando la seguridad vial. Además, al eliminar la necesidad de reenfocar constantemente, se reduce la fatiga visual durante trayectos largos.

El Equipo y la Financiación Detrás de la Innovación

Liderazgo con experiencia en gigantes tecnológicos

AllFocal Optics cuenta con un equipo directivo de primer nivel. Fundada en 2022 como Lark y posteriormente rebautizada, la empresa está dirigida por el Dr. Pawan Shrestha. Un fichaje clave fue el Dr. Ash Saulsbury, quien según Real o Virtual «ha trabajado en Microsoft, Apple y en Meta, donde lideró un proyecto de diseño, prototipado y producción de gafas AR.»

Esta combinación de experiencia académica y conocimiento de la industria posiciona a la empresa de manera única para llevar su tecnología al mercado.

Ronda de financiación estratégica

La reciente ronda de financiación de 5,3 millones de dólares, anunciada a finales de 2024, proporciona a AllFocal Optics los recursos necesarios para avanzar en el desarrollo y comercialización de su tecnología. Como detalla Wired, esta financiación coincidió aproximadamente con la incorporación del Dr. Saulsbury como presidente de la compañía.

Según Real o Virtual, estos fondos se destinarán específicamente al «desarrollo de lentes nanofotónicas para su uso en XR», con el objetivo de que «este tipo de lentes ultradelgadas podrían estar listas para ser incorporadas a gafas AR y visores VR en los próximos dos años.»

Desafíos y Perspectivas Futuras

Retos para la comercialización masiva

A pesar de su potencial revolucionario, la tecnología de AllFocal Optics enfrenta varios desafíos para su adopción masiva:

1.Fabricación a escala: Producir lentes nanofotónicas con precisión atómica a escala industrial representa un desafío manufacturero significativo.

2.Integración con dispositivos existentes: La adaptación de esta tecnología a las plataformas de VR/AR establecidas requerirá colaboraciones estratégicas con los principales fabricantes.

3.Costos iniciales: Como toda tecnología emergente, es probable que los primeros dispositivos con esta tecnología tengan un precio premium.

Cronograma de implementación

Según las fuentes consultadas, podemos esperar ver los primeros productos comerciales con esta tecnología en un futuro cercano:

•Pruebas en automóviles: A principios de 2026 con Jaguar Land Rover, según Real o Virtual.

•Integración en dispositivos VR/AR: En los próximos dos años (2026-2027), según las proyecciones de la empresa.

Implicaciones para la Industria y los Consumidores

Transformación del mercado VR/AR

La tecnología de AllFocal Optics podría catalizar una nueva ola de adopción de dispositivos VR/AR al eliminar algunas de las principales barreras actuales:

•Accesibilidad para usuarios con problemas de visión: Al eliminar la necesidad de gafas correctoras, se amplía significativamente el mercado potencial.

•Reducción de efectos secundarios: La eliminación del conflicto vergencia-acomodación podría permitir sesiones de uso más prolongadas sin fatiga visual o mareos.

•Mejora en la experiencia de lectura y trabajo: La mayor nitidez de texto podría hacer viable el uso de estos dispositivos para productividad y no solo para entretenimiento.

Revolución en la interfaz hombre-máquina en automóviles

Para la industria automotriz, esta tecnología representa una evolución natural de los sistemas de información al conductor:

•HUD más informativos y menos intrusivos: Mayor cantidad de información sin comprometer la atención a la carretera.

•Adaptación a todos los conductores: Funcionamiento óptimo independientemente de las necesidades visuales del conductor.

•Integración con sistemas de asistencia a la conducción: Potencial para mejorar la comunicación de alertas y asistencia en sistemas semi-autónomos.

Conclusión

La tecnología de proyección retiniana desarrollada por AllFocal Optics representa uno de los avances más prometedores en la forma en que interactuamos con la información visual digital. Con aplicaciones que van desde mejorar radicalmente la experiencia en dispositivos VR/AR hasta potencialmente salvar vidas mediante HUD más efectivos en automóviles, su impacto podría extenderse a múltiples industrias.

Como resume el periodista de Wired tras su experiencia con el prototipo: «Es el tipo de demostración tecnológica que se tarda un momento en apreciar de verdad, pero cuando tu cerebro por fin conecta los puntos, parece magia.»

Con una sólida base tecnológica, un equipo experimentado y financiación adecuada, AllFocal Optics parece bien posicionada para convertir esta «magia» en productos comerciales en los próximos años, potencialmente redefiniendo nuestra relación con las interfaces visuales digitales.

Referencias

1.Charlton, Alistair. «Esta tecnología que proyecta imágenes en la retina cambiará para siempre las gafas VR y los head-up displays de los autos». Wired en español, 27 de mayo de 2025.

2.»AllFocal Optics recibe 5 millones de dólares para el desarrollo de lentes nanofotónicas». Real o Virtual, 7 de noviembre de 2024.

3.»AR and VR head-up display developments aim to improve future vehicle displays, JLR set to trial new tech». Repairer Driven News, 29 de mayo de 2025.

4.»AllFocal Optics Announces $5.3M Funding Round». Auganix, 7 de noviembre de 2024.

Bio1 año ago

Bio1 año ago

EmpresasTech5 meses ago

EmpresasTech5 meses ago

Researchland1 año ago

Researchland1 año ago

AI1 año ago

AI1 año ago

Nano1 año ago

Nano1 año ago

AI5 meses ago

AI5 meses ago

AI1 año ago

AI1 año ago

AI1 año ago

AI1 año ago