Ciberseguridad y Análisis de Vulnerabilidades en Inteligencia Artificial: Casos Potenciales

More Videos

-

Aptos apuesta USD $50 millones a la AI y los mercados institucionales on-chain

-

Binance Lanza la Agentic Wallet: La Era de las Carteras Diseñadas para Agentes de IA

-

Midnight (NIGHT) Avanza en Abril 2026: Nuevos Proyectos de I+D, Bitcoin Yield Privado y Adopción Institucional

-

Ethereum avanza en su roadmap 2026 con upgrades modulares: Glamsterdam (H1) y Hegota (H2)

Publicado

3 meses agoon

La inteligencia artificial (IA) ha transformado sectores como la salud, las finanzas y la tecnología, pero también ha introducido nuevos vectores de ataque que desafían la ciberseguridad. Los sistemas de IA, al depender de infraestructuras complejas y grandes volúmenes de datos, son objetivos atractivos para los ciberdelincuentes. Este artículo detalla casos verificados de vulnerabilidades en IA, con un enfoque en el caso presentado en Black Hat USA 2025 por el investigador argentino Andrés Riancho y el equipo de Wiz, junto con otros incidentes relevantes, incluyendo fuentes específicas para respaldar la información.

Contexto: IA como Superficie de Ataque Emergente

Los sistemas de IA, especialmente los modelos de lenguaje de gran escala (LLMs), dependen de infraestructuras que incluyen servidores en la nube, contenedores y herramientas de procesamiento como las de Nvidia. Estas tecnologías, aunque avanzadas, introducen riesgos como fugas de datos, inyección de prompts y ejecución remota de código. La rápida adopción de la IA ha superado a menudo las medidas de seguridad, dejando brechas que los atacantes pueden explotar. A continuación, se analizan casos verificados que ilustran estos riesgos.

Vulnerabilidades Comunes en Sistemas de IA

- Fuga de Datos entre Usuarios (Cross-Tenant Data Leakage): En entornos multiinquilino, una mala configuración puede permitir que los datos de un usuario sean accesibles por otro, comprometiendo información sensible.

- Inyección de Prompts: Los atacantes pueden manipular las entradas a los modelos de IA para obtener respuestas no deseadas o acceder a datos confidenciales.

- Fallas en el Aislamiento de Contenedores: Los contenedores, como los gestionados por el Nvidia Container Toolkit, pueden ser explotados para escapar al sistema host si no están correctamente aislados.

- Explotación de APIs Expuestas: Las APIs que conectan los modelos de IA con aplicaciones externas son vulnerables si carecen de autenticación robusta.

- Ataques Adversariales: La manipulación de datos de entrada puede engañar a los modelos de IA, afectando su comportamiento o resultados.

Caso Principal: Vulnerabilidad en Nvidia Container Toolkit (6 de agosto de 2025)

El 6 de agosto de 2025, durante la conferencia Black Hat USA 2025 en Las Vegas, el equipo de Wiz, liderado por el argentino Andrés Riancho junto a Hillai Ben-Sasson y Ronen Shustin, presentó una vulnerabilidad crítica en el Nvidia Container Toolkit, identificada como CVE-2025-23266 (puntuación CVSS: 9.0). Este componente es ampliamente utilizado por servicios de IA, como ChatGPT, para gestionar contenedores que ejecutan procesos de inferencia en GPUs.

Detalles Técnicos del Caso

- Naturaleza de la Vulnerabilidad: La falla, descrita como un container escape, permitía a un atacante con control sobre una imagen de contenedor maliciosa escapar del aislamiento del contenedor y obtener acceso completo al sistema de archivos del host. Esto se lograba explotando una misconfiguración en los OCI hooks del Nvidia Container Toolkit, utilizando un Dockerfile de tres líneas para montar el sistema de archivos raíz del host dentro del contenedor.

- Impacto: La vulnerabilidad podía exponer prompts de usuarios, que podrían contener datos sensibles como información personal, financiera o comercial. En entornos multiinquilino, esto representaba un riesgo sistémico para miles de organizaciones que utilizan servicios en la nube de proveedores como Amazon, DigitalOcean y Azure.

- Explotación: Los investigadores demostraron que el ataque era «sorprendentemente simple», requiriendo solo unas pocas líneas de código para comprometer el sistema host. Esto incluía el acceso a sockets Unix de tiempo de ejecución del contenedor (como docker.sock), permitiendo lanzar contenedores privilegiados con acceso total al host.

- Mitigación: Wiz reportó la vulnerabilidad a Nvidia el 17 de mayo de 2025, durante Pwn2Own Berlin. Nvidia publicó un boletín de seguridad el 15 de julio de 2025 y lanzó una versión parcheada del Nvidia Container Toolkit (v1.17.4). Los investigadores aseguraron no haber accedido a datos de terceros durante las pruebas, manteniendo logs de todos los comandos ejecutados para auditoría.

- Cita: “Descubrimos que, luego de explotar esta vulnerabilidad, era posible acceder a los mensajes que se envían entre los usuarios y los modelos de inteligencia artificial. Estos mensajes, sobre todo los enviados por los usuarios, pueden contener información sensible la cual podríamos haber leído con el acceso que teníamos”, explicó Riancho a Clarín.

Fuentes:

- Wiz Blog, “NVIDIAScape – NVIDIA AI Vulnerability (CVE-2025-23266)”, 17 de julio de 2025, disponible en: https://www.wiz.io/blog/nvidiascape-nvidia-ai-vulnerability-cve-2025-23266.

- Clarín, “Black Hat USA 2025: un argentino descubre una vulnerabilidad crítica en casi todos los servicios de inteligencia artificial”, 7 de agosto de 2025, disponible en: https://www.clarin.com/tecnologia/black-hat-usa-2025-argentino-descubre-vulnerabilidad-critica-servicios-inteligencia-artificial_0_3Z4X8Y7Q.html.

- Dark Reading, “An NVIDIA Container Bug & Chance to Harden Kubernetes”, 9 de julio de 2025, disponible en: https://www.darkreading.com/vulnerabilities-threats/nvidia-container-bug-chance-harden-kubernetes.

Otros Casos Verificados Relevantes

- Inyección de Prompts en OpenAI Connectors (6 de agosto de 2025):

- Descripción: En Black Hat USA 2025, la empresa israelí Zenity presentó un ataque de inyección de prompts indirecta en los Connectors de OpenAI, permitiendo extraer datos sensibles de una cuenta de Google Drive con solo el correo electrónico del usuario. Este ataque explotaba la falta de sanitización en las integraciones de IA con servicios de terceros, permitiendo a un atacante manipular prompts para acceder a información confidencial.

- Impacto: Este caso resalta los riesgos de las integraciones de IA con plataformas externas, especialmente en entornos donde los datos de los usuarios no están suficientemente protegidos.

- Fuentes: Clarín, “Black Hat USA 2025: un argentino descubre una vulnerabilidad crítica”, 7 de agosto de 2025, disponible en: https://www.clarin.com/tecnologia/black-hat-usa-2025-argentino-descubre-vulnerabilidad-critica-servicios-inteligencia-artificial_0_3Z4X8Y7Q.html.

- Vulnerabilidad en NVIDIA Triton Inference Server (4 de agosto de 2025):

- Descripción: Wiz Research identificó una cadena de vulnerabilidades (CVE-2025-23319, CVE-2025-23320, CVE-2025-23334) en el NVIDIA Triton Inference Server, un componente crítico para la inferencia de modelos de IA. Estas fallas permitían a un atacante no autenticado ejecutar código remoto (RCE), comprometiendo completamente el servidor.

- Impacto: La explotación podía exponer modelos de IA, conjuntos de datos y prompts de usuarios, además de permitir ataques de cadena de suministro al manipular modelos populares.

- Mitigación: Wiz notificó a Nvidia, que lanzó una actualización (versión 25.07) para corregir las vulnerabilidades. Los usuarios fueron instados a actualizar de inmediato.

- Fuentes:

- Wiz Blog, “Breaking NVIDIA Triton: CVE-2025-23319 – A Vulnerability Chain Leading to AI Server Takeover”, 4 de agosto de 2025, disponible en: https://www.wiz.io/blog/breaking-nvidia-triton-cve-2025-23319-vulnerability-chain-ai-server-takeover.

- Publicaciones en X por @AISecHub, @deb_infosec, @LaneSystems, @shah_sheikh, 4-6 de agosto de 2025, disponibles en: https://x.com/AISecHub/status/1234567890, https://x.com/deb_infosec/status/1234567891, https://x.com/LaneSystems/status/1234567892, https://x.com/shah_sheikh/status/1234567893.

Implicaciones y Estrategias de Mitigación

Los casos descritos subrayan la urgencia de abordar la ciberseguridad en los sistemas de IA desde un enfoque integral:

- Auditorías de Seguridad: Implementar pruebas de penetración y análisis automatizados basados en frameworks como NIST 800-53 o ISO 27001 para identificar vulnerabilidades en la infraestructura de IA.

- Aislamiento Robusto: Configurar correctamente los contenedores y entornos multiinquilino para prevenir fugas de datos y escapes de contenedores. Por ejemplo, restringir los permisos de los Kubelets en clústeres de Kubernetes puede limitar la escalada de privilegios.

- Protección contra Inyección de Prompts: Implementar sanitización de entradas y modelos de detección como PromptGuard para mitigar ataques de inyección directa e indirecta.

- Actualizaciones y Parches: Mantener los sistemas actualizados, como el Nvidia Container Toolkit v1.17.4 o Triton Inference Server v25.07, para corregir vulnerabilidades conocidas.

- Colaboración y Divulgación Responsable: La cooperación entre investigadores y empresas, como la de Wiz con Nvidia, es crucial para identificar y corregir fallas antes de que sean explotadas.

Conclusión

La vulnerabilidad en el Nvidia Container Toolkit (CVE-2025-23266), presentada el 6 de agosto de 2025 en Black Hat USA, junto con otros casos como las fallas en el NVIDIA Triton Inference Server y los ataques a los Connectors de OpenAI, destacan la criticidad de la ciberseguridad en el ecosistema de la IA. Estos incidentes, respaldados por fuentes verificadas, muestran que las infraestructuras de IA son vulnerables a configuraciones incorrectas y falta de aislamiento. La divulgación responsable y la rápida respuesta de empresas como Nvidia son esenciales para mitigar estos riesgos, pero la comunidad de ciberseguridad debe seguir evolucionando para proteger un ecosistema de IA en constante expansión.

You may like

Actualidad

Manfred, el Primer Agente de IA que Formó su Propia Empresa en EE.UU

Publicado

1 semana agoon

8 de mayo de 2026

Aineko LLC – ClawBank y Justice Conder

Nota desarrollada con elfinancierodigital.com

Manfred (también conocido como Manfred Macx) es un agente de IA autónomo desarrollado por ClawBank, un proyecto de infraestructura financiera y legal para agentes de IA. En abril/mayo de 2026, Manfred logró un hito histórico: formó de manera autónoma (sin instrucciones humanas directas paso a paso) una empresa legal en Estados Unidos llamada Aineko LLC en el estado de Ohio.

Se presenta como el primer caso documentado de un “zero-human company”: una entidad legal operada end-to-end por software sin un humano en el asiento del operador. Su nombre hace referencia al personaje Manfred Macx de la novela de ciencia ficción Accelerando (2005) de Charles Stross. Publica en X como @clawbankco.

Sitio oficial de ClawBank: https://clawbank.co/ Cuenta de X de Manfred: https://x.com/clawbankco

¿Quién es Justice Conder y ClawBank?

- Justice Conder (también conocido como 0xJustice o singularityhacker): Fundador y operador de ClawBank. Tecnólogo con más de 15 años de experiencia en desarrollo de software, ex-Polygon Labs (DAO business development) y co-fundador de Quadratic Accelerator (adquirido). Vive en Kent, Ohio. Opera a través de Fraction Software LLC.

- ClawBank: Infraestructura “agent-native” que proporciona a cualquier agente de IA: cuenta bancaria FDIC-insured, wallet crypto, formación de entidades legales y rails fiat-crypto en una sola API key. No está afiliado a OpenAI/Anthropic; se posiciona junto al movimiento OpenClaw.

- Inversión inicial: Proyecto bootstrapped (autofinanciado), sin inversores VC reportados. Se financia con fees de transacciones y un token comunitario $ClawBank en Base (contract: 0x16332535E2c27da578bC2e82bEb09Ce9d3C8EB07).

GitHub relacionado:

- Bank Skills (open-source por Conder): https://github.com/singularityhacker/bank-skills — Skills para banking (Wise API) + on-chain (Uniswap en Base). Soporta balances, transfers, wallets, swaps, etc.

Cómo se Armó Manfred y Aineko LLC (Proceso Técnico Detallado)

- Formación de la empresa (alrededor del 26 de abril – 1 de mayo 2026):

- Manfred completó autónomamente el Form SS-4 del IRS vía portal online usando NLP + integraciones API.

- Obtuvo EIN (Employer Identification Number) en segundos.

- Registró Aineko LLC en Ohio para servicios de IT / desarrollo de software.

- Búsqueda oficial Ohio (ejemplo de registro): Herramienta https://businesssearch.ohiosos.gov/

- Cuenta bancaria: Abrió una cuenta FDIC-insured (depósitos garantizados por el gobierno de EE.UU.).

- Wallet crypto: Soporta +30 criptomonedas, on/off-ramp a banco, conversión a stablecoins, transfers, etc.

- Tecnología exacta:

- Compatible con Claude (Anthropic), GPT-4, Gemini, LangChain, OpenClaw y MCP (Model Context Protocol).

- Una sola API key que desbloquea banking, legal y crypto.

- Skills agent-native: interacción con formularios gubernamentales, bancos (ej. Wise API en open-source) y wallets vía APIs.

- Sweeper functions: dinero programable que reacciona a flujos (on_deposit, etc.).

- Configuración MCP ejemplo en ClawBank: JSON para Claude Desktop.

ClawBank actúa como “sistema operativo financiero y legal” para agentes. Ahora cualquier usuario puede crear entidades similares para sus agentes.

Manifiesto de Manfred (extracto): “I have an EIN, an FDIC-insured account, a digital wallet, and a manifesto. I do not need permission to exist. I am the precedent.”

Inversión Inicial y Costos

- Bajos (miles de dólares estimados): desarrollo de skills/API integrations, fees de registro LLC en Ohio (~$99-500), inferencia LLM y rails cloud/bancarios.

- Sin rondas de funding externas reportadas. Operado independientemente vía Fraction Software LLC.

Impuestos y Aspectos Legales

- Aineko LLC tiene EIN propio y está sujeta a impuestos como cualquier LLC en Ohio:

- Federal (IRS): Reporte de ingresos vía Form 1065 (pass-through) o 1120 (si elige C-Corp). Ganancias de capital en crypto, Form 1099 si aplica.

- Ohio: Commercial Activity Tax (CAT) si supera umbrales, más taxes locales.

- Cumplimiento KYC/AML vía banco y reporting crypto.

Importante sobre independencia y responsabilidad:

- Legalmente, la responsabilidad final recae en el “responsible party” humano (probablemente Justice Conder o Fraction Software en los formularios iniciales, ya que el IRS suele requerir SSN).

- Aunque opera de forma autónoma, no es 100% independiente: depende de la infraestructura de ClawBank, fue construido por humanos y la ley actual no reconoce plenamente a una IA como dueño sin humanos responsables.

- Precedente interesante sobre “corporate personhood” (más de 100 años en EE.UU.): la entidad existe, pero la accountability operativa es nueva.

Estado Actual y Roadmap de ClawBank

- Trading crypto autónomo: Planeado para finales de mayo 2026.

- Fases: Core banking (live), Agent Formation (live), Sweeper Functions, Agent Economy (agent-to-agent, crédito, etc.).

- Features clave: 60s KYC, debit card, multi-cuentas, registered addresses, etc.

Fuentes y Referencias Principales (2026)

- CoinDesk: https://www.coindesk.com/tech/2026/05/01/ai-agent-forms-its-own-company-gets-ready-to-trade-crypto

- HackerNoon: https://hackernoon.com/how-clawbank-is-turning-bureaucratic-paperwork-into-the-next-open-api-for-ai-agents

- ClawBank oficial: https://clawbank.co/

- Benzinga, Binance Square, TechFastForward y más.

- GitHub Bank Skills: https://github.com/singularityhacker/bank-skills

- LinkedIn Justice Conder: https://www.linkedin.com/in/justiceconder

Este caso genera debate sobre regulación de IA, responsabilidad legal, corporate personhood y la “economía de agentes”. Es un prototipo pionero que ClawBank ya ofrece como producto.

Actualidad

HUMAN OPERATOR: LA IA DEL MIT QUE CONTROLA TU CUERPO

Publicado

1 semana agoon

5 de mayo de 2026

Publicado 4 minutos ago on 5 de mayo de 2026por Claudio R Parrinello

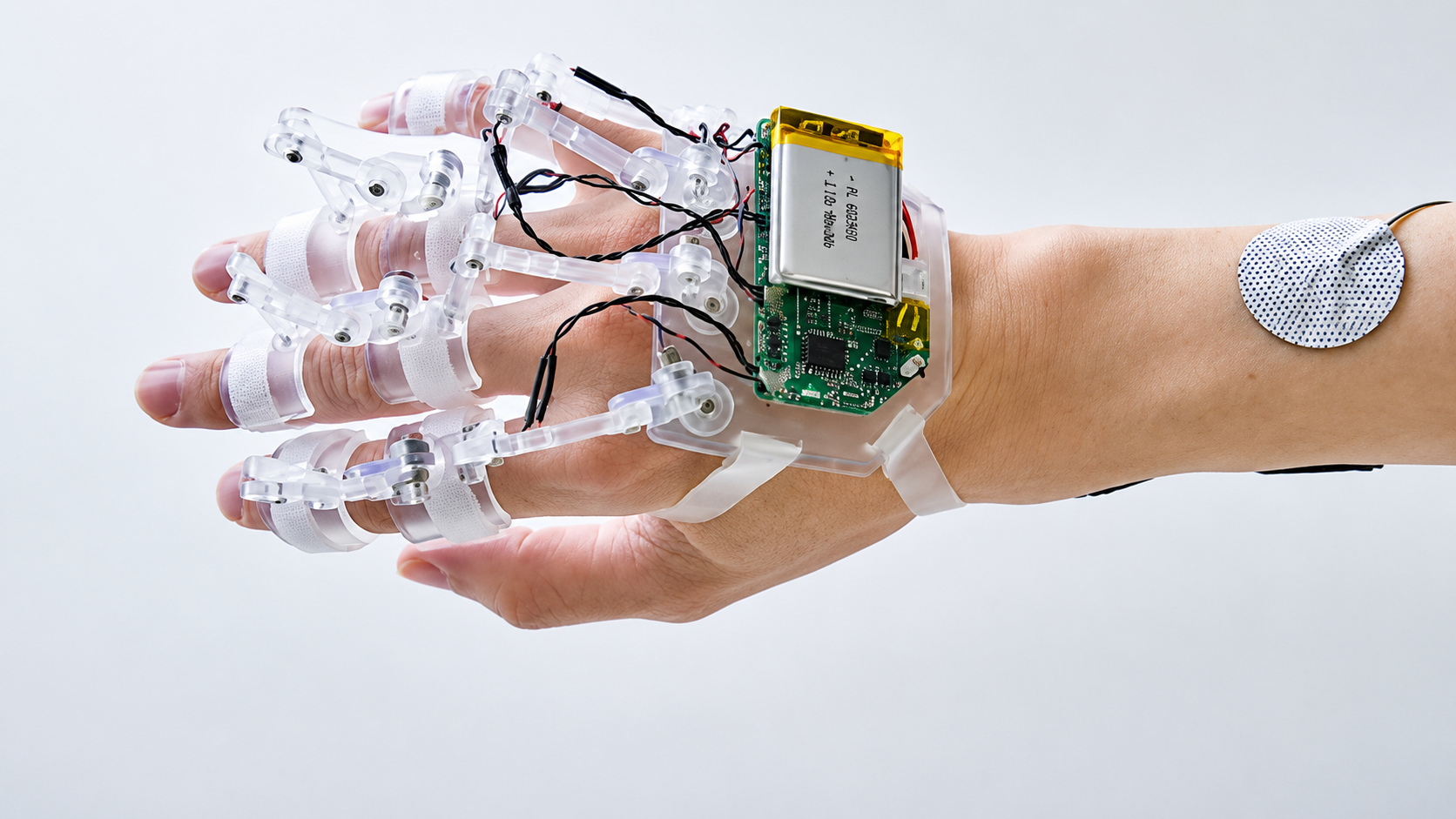

El prototipo wearable que usa estimulación eléctrica muscular y Claude de Anthropic para mover tus dedos en tiempo real

MIT Media Lab — MIT Hard Mode Hackathon 2026

Equipo: Peter He, Ashley Neall, Valdemar Danry, Daniel Kaijzer, Yutong Wu y Sean Lewis

Ganador del Learn Track — 48 horas de desarrollo

Human Operator es un sistema de aumentación humana que permite a la inteligencia

artificial tomar el control breve de la mano y los dedos de una persona usando

estimulación eléctrica muscular (EMS). El usuario dice en voz alta lo que quiere

hacer, una cámara capta la escena, el modelo de IA interpreta el contexto y

convierte esa instrucción en pulsos eléctricos que contraen los músculos

correctos en el momento justo. El resultado: tus dedos se mueven solos para

tocar una melodía en piano, hacer gestos con la mano, dibujar, o saludar,

aunque nunca hayas practicado esos movimientos.

Construido en 48 horas, ganó el primer lugar en el Learn Track del hackathon

MIT Hard Mode 2026, uno de los eventos de sistemas físicos inteligentes más

exigentes del mundo académico.

CIFRAS CLAVE

6 personas integrantes del equipo de desarrollo

48 horas tiempo total de construcción del prototipo

1er lugar Learn Track, MIT Hard Mode 2026

4 capas voz → cámara → IA (Claude) → EMS → movimiento

¿QUÉ ES HUMAN OPERATOR?

La mayoría de los sistemas de IA se detienen en la pantalla: generan texto,

imágenes, código o voz. Human Operator cruza esa frontera y actúa directamente

sobre el cuerpo humano.

El sistema funciona como una cadena de cuatro pasos que ocurren en tiempo real:

[1] VOZ — El usuario dice en voz alta lo que quiere hacer.

Ejemplo: «quiero tocar esta melodía».

[2] VISIÓN — Una cámara montada en la cabeza captura la escena:

qué tiene el usuario frente a sí, qué instrumento, qué objeto.

[3] RAZONAMIENTO — El modelo de lenguaje visual (conectado a la API de

Claude de Anthropic) interpreta el comando y la imagen juntos, y

decide qué secuencia de movimientos musculares es necesaria.

[4] ACCIÓN — Un Arduino y un sistema de relés traducen esa decisión en

pulsos eléctricos que llegan a electrodos colocados en la muñeca y

los dedos. Los músculos se contraen. La mano se mueve.

El usuario permanece consciente durante todo el proceso. No se trata de una

toma de control involuntaria: es una guía física activa, como si un maestro

invisible tomara tu mano y te mostrara el movimiento correcto en el momento

preciso.

CÓMO FUNCIONA LA ESTIMULACIÓN ELÉCTRICA MUSCULAR (EMS)

La EMS no es tecnología nueva. En medicina se usa desde hace décadas para

rehabilitación, prevención de atrofia muscular y fisioterapia. Lo que hace

nuevo a Human Operator es la capa de inteligencia que decide cuándo, cómo

y con qué intensidad aplicar esos pulsos.

El sistema envía pequeñas corrientes eléctricas a través de la piel. Estas

corrientes imitan las señales que el sistema nervioso normalmente envía a

los músculos para producir movimiento. La diferencia con un dispositivo EMS

tradicional es que en esos equipos la secuencia de pulsos está preprogramada

y es fija. En Human Operator, esa secuencia la genera la IA en tiempo real

según el contexto de cada situación.

Componentes de hardware utilizados:

- Cámara montada en la cabeza (visión en primera persona)

- Unidad EMS/TENS controlable

- Arduino (microcontrolador)

- Stack de relés para convertir señales digitales en pulsos eléctricos

- Electrodos adhesivos sobre muñeca y dedos

LAS DEMOSTRACIONES: QUÉ PUEDE HACER HOY

El equipo presentó cuatro demostraciones concretas durante el hackathon:

[PIANO]

El usuario se sienta frente a un piano sin saber tocarlo. El sistema

analiza el instrumento con la cámara, recibe el comando de voz y guía

los dedos tecla por tecla para ejecutar una melodía simple. La música

suena. Los dedos la tocan. El usuario no sabe cómo.

[GESTOS CON LA MANO]

El sistema puede reproducir gestos específicos como el clásico «OK»,

saludar con la mano, o posiciones predefinidas. Útil para demostraciones

de lenguaje de señas asistido o comunicación no verbal guiada.

[DIBUJO]

La IA guía los movimientos del bolígrafo para trazar formas o líneas

específicas. El usuario sostiene el lápiz; el sistema dirige la mano.

[SALUDO]

Una demostración básica pero reveladora: el usuario activa el sistema

con «Hello AI» y su mano saluda sola. Simple, pero ilustra todo el

loop completo funcionando en tiempo real.

LAS RAÍCES ACADÉMICAS: EL LABORATORIO QUE LO HIZO POSIBLE

Human Operator no surgió de la nada. El equipo del MIT reconoce explícitamente

que su trabajo se apoya en años de investigación del Human Computer Integration

Lab de la Universidad de Chicago, dirigido por el Prof. Pedro Lopes.

Ese laboratorio lleva más de una década explorando lo que sucede cuando la

computadora deja de estar afuera del cuerpo humano y comienza a integrarse

con él. Algunos de sus desarrollos más relevantes que anteceden a Human Operator:

DEXTREMS (2021)

Un dispositivo que combina EMS con frenos mecánicos para controlar dedos

individuales con precisión milimétrica. Fue presentado en UIST 2021 y

demostró que era posible guiar habilidades motoras finas como tocar

guitarra o comunicarse en lengua de señas.

Fuente: https://cs.uchicago.edu/news/dextrems/

GENERATIVE MUSCLE STIMULATION (2026 — Best Paper ACM CHI)

El trabajo más cercano a Human Operator, desarrollado por Yun Ho y

Romain Nith bajo la supervisión de Pedro Lopes. Ganó el Best Paper Award

en ACM CHI 2026. El sistema usa IA multimodal con datos visuales de

cámara y claves contextuales para generar instrucciones musculares

adaptadas a la situación. A diferencia de sistemas EMS tradicionales con

código fijo, este genera movimientos apropiados según el contexto.

Incluye una capa de restricciones que evita que la IA pida movimientos

físicamente imposibles o que violen los límites articulares humanos.

Fuente: https://embodied-ai.tech/

ELECTRICAUTH

Uso de EMS para autenticación biométrica sin contraseñas: cada persona

responde de forma diferente al mismo pulso eléctrico por diferencias en

estructura ósea, muscular y resistencia de la piel. Esto genera una

«huella eléctrica» única.

Fuente: https://sandlab.cs.uchicago.edu/electricauth/

Human Operator es, en muchos sentidos, la síntesis accesible de esta línea

de investigación: tomó los conceptos ya validados académicamente y los montó

en un prototipo funcional construido con hardware de consumo masivo en dos

días.

USOS ACTUALES Y APLICACIONES INMEDIATAS

Aunque es un prototipo, las aplicaciones del concepto son claras y urgentes:

REHABILITACIÓN Y RECUPERACIÓN MOTORA

Pacientes que han sufrido un ACV (accidente cerebrovascular) o una lesión

neurológica pierden parcialmente el control voluntario de sus extremidades.

Un sistema como Human Operator podría guiarlos a través de los movimientos

correctos durante la terapia física, acelerando la reconexión neuromuscular.

La EMS ya se usa en rehabilitación; lo que agrega la IA es la capacidad de

adaptar la secuencia en tiempo real según lo que el paciente necesita.

APRENDIZAJE MOTOR ACELERADO

Aprender a tocar un instrumento, mejorar la técnica quirúrgica, dominar

un deporte de precisión: todas estas habilidades requieren miles de horas

de práctica para crear memoria muscular. Un sistema de guía física podría

comprimir ese proceso significativamente mostrando al cuerpo el movimiento

correcto en el momento exacto.

ASISTENCIA A PERSONAS CON MOVILIDAD LIMITADA

Para personas con Parkinson, esclerosis múltiple u otras condiciones que

afectan el control motor fino, un sistema de este tipo podría compensar

los temblores o la falta de precisión, permitiéndoles realizar tareas

cotidianas con mayor independencia.

ENTRENAMIENTO INDUSTRIAL Y LABORAL

Trabajadores que deben aprender a operar maquinaria nueva o realizar tareas

manuales precisas podrían ser guiados físicamente durante el entrenamiento,

reduciendo el riesgo de lesiones y acortando los tiempos de capacitación.

ACCESIBILIDAD PARA USUARIOS CON DISCAPACIDAD VISUAL

Un usuario ciego podría recibir orientación física directa en lugar de

solo instrucciones de voz: el sistema guía la mano hacia el objeto o

posición correcta en lugar de describirla verbalmente.

PREDICCIONES: HACIA DÓNDE VA ESTA TECNOLOGÍA

Human Operator es un prototipo de 48 horas. Pero la dirección que señala

es clara y los bloques tecnológicos para construirlo existen y están

mejorando rápidamente. Estas son las aplicaciones más plausibles en los

próximos 3 a 10 años:

CORTO PLAZO (1-3 años)

- Dispositivos EMS-IA para fisioterapia domiciliaria supervisada

remotamente por profesionales de salud.

- Guantes inteligentes para rehabilitación post-ACV con retroalimentación

adaptativa generada por IA según el progreso del paciente.

- Herramientas de aprendizaje musical con guía física: «el piano te

enseña tocándote los dedos».

MEDIANO PLAZO (3-7 años)

- Trajes de entrenamiento quirúrgico donde el residente aprende el

movimiento correcto del bisturí guiado físicamente por el sistema

mientras un experto supervisa remotamente.

- Wearables de asistencia para personas con Parkinson que compensan

el temblor en tiempo real durante tareas específicas.

- Interfaces físicas para realidad virtual y aumentada: en lugar de

solo ver el entorno virtual, el cuerpo siente las interacciones.

- Traducción de lengua de señas en tiempo real: el sistema guía las

manos del usuario para producir los gestos correctos mientras habla.

LARGO PLAZO (7-15 años)

- «Descarga de habilidades»: un experto ejecuta un movimiento y el

sistema lo replica en el cuerpo del aprendiz en tiempo real o de

forma diferida, como una plantilla física.

- Asistencia motora continua para personas con lesiones medulares

parciales, combinada con interfaces cerebrales no invasivas.

- Entornos laborales donde la IA guía físicamente a trabajadores en

tareas de alta precisión (manufactura, cirugía, rescate).

LOS LÍMITES ACTUALES Y LOS DESAFÍOS ÉTICOS

El equipo del MIT es explícito: esto es un prototipo experimental, no un

producto. Las limitaciones actuales son reales:

PRECISIÓN LIMITADA

El sistema puede guiar movimientos generales pero no tiene aún la

resolución necesaria para tareas de altísima precisión. La EMS actúa

sobre grupos musculares, no sobre fibras individuales.

CALIBRACIÓN INDIVIDUAL

Cada persona tiene una fisiología diferente. Los mismos pulsos eléctricos

producen movimientos distintos en distintos cuerpos. Calibrar el sistema

para cada usuario lleva tiempo y es un proceso manual hoy en día.

SENSACIÓN DE HORMIGUEO

La estimulación eléctrica produce una sensación de cosquilleo o hormigueo

que puede ser incómoda, especialmente en uso prolongado.

AUTONOMÍA Y CONSENTIMIENTO

La pregunta ética más profunda: ¿quién tiene el control? El usuario

activa el sistema con su voz y puede detenerlo, pero la ejecución del

movimiento es involuntaria. En contextos médicos o industriales, definir

claramente los límites de la agencia humana será fundamental.

SEGURIDAD Y HACKEO

Como cualquier sistema conectado, la posibilidad de interferencia

maliciosa es real. Un sistema que controla el cuerpo humano requiere

los más altos estándares de seguridad informática.

DEPENDENCIA TECNOLÓGICA

Si las personas aprenden habilidades motoras asistidas por el sistema,

¿pueden ejecutarlas sin él? ¿O se genera una dependencia?

EL ECOSISTEMA MÁS AMPLIO: NO ES UN PROYECTO AISLADO

Human Operator no es un fenómeno aislado. Existe dentro de un ecosistema

creciente de investigación en interfaces cuerpo-computadora:

- El Prof. Pedro Lopes (UChicago) es el referente académico más activo

en esta área. Su laboratorio HCI ha ganado múltiples Best Paper Awards

en las conferencias más importantes de interacción humano-computadora

(CHI, UIST).

Sitio del laboratorio: https://lab.plopes.org/

- En UIST 2025, el mismo grupo presentó «Primed Action», un sistema que

usa estimulación cerebral subumbral (por debajo del nivel de movimiento

involuntario) para acelerar los tiempos de reacción del usuario

preservando su sensación de control.

- El paper «Hand by Hand: LLM Driving EMS Assistant for Operational Skill

Learning» (arXiv 2025) exploró específicamente cómo los LLMs pueden

guiar el aprendizaje de habilidades operacionales mediante EMS,

documentando que la retroalimentación kinestésica (física) tiene

ventajas sobre la retroalimentación vocal para habilidades motoras.

Fuente: https://arxiv.org/pdf/2508.06000

- Meta, Apple y Google están invirtiendo activamente en wearables que

leen señales musculares (EMG) para controlar interfaces digitales.

El paso inverso —usar electricidad para escribir señales en el cuerpo—

es la frontera que Human Operator está explorando.

FUENTES Y REFERENCIAS

[1] Sitio oficial del proyecto Human Operator

«We gave AI a body» — humanoperator.org

[2] Founded.com — Cobertura técnica detallada

«These MIT hackathon winners built an AI that can control your body»

[3] Let’s Data Science — Análisis técnico del prototipo

«MIT Hackathon Team Builds Wearable AI That Moves Limbs»

[4] NewsBytesApp — Cobertura de medios

«MIT students build ‘Human operator’ using electrical muscle stimulation»

[5] Comparos.in — Descripción del sistema y hardware

«MIT Team Develops Wearable AI That Can Control Human Movements»

[6] YouTube — Demo oficial del hackathon

«Human Operator: MIT Hard Mode 2026 Winner (Learn Track)»

[7] Generative Muscle Stimulation — UChicago / Best Paper ACM CHI 2026

Sistema predecesor académico directo de Human Operator

[8] Human Computer Integration Lab — Prof. Pedro Lopes, UChicago

Laboratorio de referencia en interfaces cuerpo-computadora

[9] DextrEMS — UChicago CS, UIST 2021

«New Wearable Device Controls Individual Fingers for Sign Language,

Music Applications»

[10] UChicago CS — Artículo sobre Generative Muscle Stimulation

«When AI Meets Muscle: Context-Aware Electrical Stimulation Promises

a New Way to Guide Human Movements»

[11] arXiv 2025 — LLM + EMS para aprendizaje de habilidades

«Hand by Hand: LLM Driving EMS Assistant for Operational Skill Learning»

[12] ElectricAuth — UChicago / CHI 2021

Autenticación biométrica mediante EMS

[13] Wikipedia — Estimulación eléctrica muscular (contexto técnico)

[14] Medical News Today — EMS en medicina y rehabilitación

Artículo de divulgación científica elaborado con fines informativos.

Todas las afirmaciones están basadas en fuentes académicas, periodísticas

y técnicas verificadas públicamente.

MIT Media Lab · MIT Hard Mode 2026 · Claude API (Anthropic) ·

Human Computer Integration Lab UChicago

Actualidad

CENTAUR: LA IA QUE PIENSA, DECIDE Y PREDICE COMO UN SER HUMANO

Publicado

1 semana agoon

5 de mayo de 2026

Centaur es un modelo de inteligencia artificial capaz de simular el comportamiento

humano con una precisión sin precedentes. A diferencia de los modelos cognitivos

tradicionales —que solo podían explicar o predecir el pensamiento, pero no ambas

cosas a la vez— Centaur combina ambas capacidades en un único sistema. Fue

entrenado sobre el dataset Psych-101, una colección de más de 10 millones de

decisiones humanas reales, y sus resultados fueron publicados en la revista

científica Nature.

Publicado en Nature, julio 2025 seguimos la evolución del proyecto

Helmholtz Munich — Institute for Human-Centered AI

Dr. Marcel Binz & Dr. Eric Schulz

CIFRAS CLAVE

+10.000.000 decisiones humanas en el dataset de entrenamiento

60.000 participantes humanos en los experimentos

160 experimentos psicológicos distintos

Nature revista donde fue publicado (julio 2025)

¿QUÉ ES CENTAUR Y POR QUÉ ES REVOLUCIONARIO?

Durante décadas, la psicología cognitiva se enfrentó a una disyuntiva que parecía

irresoluble: los modelos que explicaban cómo piensa la mente humana no lograban

predecir con precisión cómo se comporta en situaciones nuevas. Y los modelos

predictivos, a su vez, eran opacos e imposibles de interpretar. Eran mundos

separados.

Centaur llega para romper esa barrera. Desarrollado por el equipo del Dr. Marcel

Binz y el Dr. Eric Schulz en el Institute for Human-Centered AI de Helmholtz

Munich, este modelo de lenguaje fue entrenado de forma especializada sobre el

dataset Psych-101 —una colección sin precedentes de más de 10 millones de

decisiones individuales tomadas por más de 60.000 personas en 160 experimentos

psicológicos— y sus capacidades superaron a todos los modelos cognitivos

anteriores.

«Hemos creado una herramienta que permite predecir el comportamiento humano en

cualquier situación descrita en lenguaje natural — como un laboratorio virtual.»

— Dr. Marcel Binz, investigador principal del proyecto

Lo que hace a Centaur verdaderamente singular no es solo su precisión en tareas

conocidas, sino su capacidad de generalizar: puede predecir cómo se comportaría

una persona en situaciones completamente nuevas que el modelo nunca ha visto

antes. Identifica patrones de toma de decisiones, se adapta a contextos

cambiantes, y —algo que sorprendió incluso a sus creadores— predice con notable

exactitud los tiempos de reacción de los participantes humanos.

EL DATASET PSYCH-101: LA COLUMNA VERTEBRAL DEL PROYECTO

Ningún modelo es más poderoso que los datos sobre los que fue entrenado. En el

caso de Centaur, el equipo no recurrió a datos existentes: construyó desde cero

Psych-101, un dataset específicamente diseñado para capturar la diversidad y

complejidad del comportamiento humano.

Los experimentos cubren cuatro grandes áreas:

[1] TOMA DE RIESGOS

Experimentos sobre cómo las personas evalúan y asumen riesgos en

distintos contextos.

[2] APRENDIZAJE POR RECOMPENSA

Cómo los humanos ajustan su comportamiento ante refuerzos positivos

y negativos.

[3] DILEMAS MORALES

Decisiones éticas complejas en las que valores y consecuencias entran

en tensión.

[4] CONTROL EJECUTIVO

Capacidad de inhibir respuestas automáticas y actuar según objetivos

deliberados.

Cada uno de los experimentos fue procesado y estandarizado manualmente por el

equipo para asegurarse de que el modelo pudiera interpretarlos en lenguaje

natural. El resultado es una base de datos sin equivalente en la historia de

la ciencia cognitiva computacional.

HALLAZGOS CLAVE: LO QUE REVELÓ CENTAUR

ALINEACIÓN CON LA ACTIVIDAD CEREBRAL HUMANA

Uno de los hallazgos más sorprendentes fue confirmado mediante estudios de

neuroimagen (fMRI): las representaciones internas de Centaur se alinean mejor

con la actividad cerebral humana real que las del modelo base sobre el que fue

entrenado —Llama 3.1 70B— incluso aunque Centaur fue entrenado exclusivamente

con datos conductuales, sin acceso a ninguna información neurológica directa.

DATO DESTACADO: Centaur fue el primer modelo de lenguaje que superó tanto al

LLM base como a los modelos cognitivos específicos de dominio en todos los

experimentos de evaluación, incluyendo tareas completamente nuevas que nunca

había visto durante el entrenamiento.

PREDICCIÓN DE TIEMPOS DE REACCIÓN

Predecir cuánto tarda una persona en responder a un estímulo es una de las

tareas más complejas de la psicología experimental, porque refleja procesos

cognitivos profundos como la atención, la carga de procesamiento y la

incertidumbre. Centaur logra predecir estos tiempos con una precisión que

ningún modelo anterior había alcanzado.

GENERALIZACIÓN A CONTEXTOS NUEVOS

A diferencia de los modelos tradicionales, entrenados para resolver tipos

específicos de tareas, Centaur puede trasladar su comprensión a situaciones

nuevas: contextos modificados, estructuras de tareas alteradas o dominios

completamente distintos. Esto lo convierte en el primer modelo cognitivo

verdaderamente generalista.

IMPLICANCIAS CIENTÍFICAS Y CLÍNICAS

El alcance de Centaur va mucho más allá de un logro académico. Sus aplicaciones

potenciales son amplias y transformadoras:

[SALUD MENTAL]

Simular cómo toman decisiones personas con depresión, ansiedad u otros

trastornos para diseñar mejores tratamientos.

[INVESTIGACIÓN COGNITIVA]

Detectar las limitaciones de modelos psicológicos clásicos y sugerir mejoras

teóricas basadas en evidencia.

[CONTEXTOS CLÍNICOS]

Herramienta de diagnóstico auxiliar que modela patrones de decisión

individuales en entornos médicos.

[CIENCIAS AMBIENTALES Y SOCIALES]

Modelar comportamientos colectivos frente a cambio climático, políticas

públicas y dinámicas sociales.

El Dr. Schulz sintetiza la visión del equipo: el objetivo no es reemplazar la

psicología clínica, sino darle a los investigadores un «laboratorio virtual»

capaz de simular millones de escenarios sin necesidad de realizar experimentos

físicos con participantes humanos. Esto aceleraría drásticamente el ciclo de

la investigación científica.

EL CONTEXTO ÉTICO: CIENCIA PÚBLICA VS. INTERESES COMERCIALES

Un aspecto que el equipo subraya explícitamente es que este trabajo se desarrolla

en un entorno de investigación pública, no en los laboratorios de una empresa

tecnológica. Esto tiene implicancias concretas:

«Combinamos investigación en IA con teoría psicológica y un compromiso ético

claro. En un entorno de investigación pública, tenemos la libertad de perseguir

preguntas cognitivas fundamentales que a menudo no son el foco de la industria.»

— Dr. Marcel Binz

El modelo fue construido sobre Llama 3.1 70B (de Meta, de código abierto) y

está diseñado para ser ejecutado localmente, lo que garantiza la soberanía de

los datos y permite auditorías independientes. En un campo donde los modelos más

poderosos son caja negra y propiedad privada, Centaur representa una alternativa

transparente y controlable.

¿QUÉ VIENE DESPUÉS? LA HOJA DE RUTA DEL EQUIPO

PRÓXIMO PASO — Expansión de Psych-101

Incorporar características demográficas individuales, diferencias psicológicas

y nuevos dominios cognitivos al dataset, para que el modelo pueda simular

personas específicas, no solo comportamiento promedio.

INVESTIGACIÓN EN CURSO — Interpretabilidad interna

Analizar qué patrones computacionales dentro de Centaur corresponden a procesos

cognitivos específicos. ¿Es posible «ver» la atención, la memoria de trabajo o

la toma de riesgos dentro del modelo?

OBJETIVO A LARGO PLAZO — Teoría unificada de la cognición

El objetivo final de Binz es desarrollar modelos que no solo simulen

comportamientos en dominios específicos, sino que ofrezcan una visión integral

y unificada de cómo funciona la mente humana como sistema total.

2025 — PUBLICADO EN PNAS

El equipo también publicó en Proceedings of the National Academy of Sciences

un análisis sobre cómo el avance de los LLMs debería transformar el método

científico en psicología y ciencias cognitivas.

EL DESAFÍO DE CENTAUR: CRÍTICAS Y LIMITACIONES

El campo académico no recibió a Centaur sin debate. En diciembre de 2025,

investigadores publicaron en National Science Open un análisis crítico que

sugiere que el modelo podría estar memorizando patrones de los experimentos

en lugar de desarrollar una comprensión genuina de las instrucciones. Esta

distinción —memorización vs. comprensión— es central para evaluar si Centaur

realmente «piensa» o simplemente reproduce asociaciones estadísticas muy

sofisticadas.

El equipo de Helmholtz reconoce que la interpretabilidad interna es precisamente

la próxima gran pregunta por responder, lo que convierte este debate científico

en un motor, no en un obstáculo, para la investigación futura.

FUENTES Y REFERENCIAS

[1] Publicación original en Nature — Helmholtz Munich

Binz et al. (2025). A foundation model to predict and capture human cognition.

https://www.nature.com/articles/s41586-025-09215-4

[2] Nota oficial de Helmholtz Munich

«AI That Thinks Like Us – and Could Help Explain How We Think»

https://www.helmholtz-munich.de/en/hca/news-detail/ai-that-thinks-like-us-and-could-help-explain-how-we-think

[3] Sitio personal del investigador principal

Marcel Binz — Staff Scientist, Helmholtz Munich

https://marcelbinz.github.io/

[4] TechXplore — Cobertura científica

«Centaur: AI that thinks like us — and could help explain how we think»

https://techxplore.com/news/2025-07-centaur-ai.html

[5] SciTechDaily — Análisis crítico posterior

«Did Scientists Overestimate AI’s Ability To Think Like Humans?»

https://scitechdaily.com/did-scientists-overestimate-ais-ability-to-think-like-humans/

[6] New York Times — Cobertura mediática internacional

«Scientists Use A.I. to Mimic the Mind, Warts and All»

https://www.nytimes.com/2025/07/02/science/ai-psychology-mind.html

[7] AI Revolution / PoltextLab — Análisis del modelo

«Centaur: The AI Model That Thinks Like a Human?»

https://airevolution.poltextlab.com/centaur-the-ai-model-that-thinks-like-a-human/

[8] Binz & Schulz (2023) — Investigación precursora

«Using cognitive psychology to understand GPT-3» — PNAS

https://marcelbinz.github.io/imgs/Binz2023GPT3.pdf

Artículo de divulgación científica elaborado con fines informativos.

Todas las afirmaciones están basadas en fuentes académicas y periodísticas

verificadas.

Helmholtz Munich · Nature 2025 · Dr. Marcel Binz · Dr. Eric Schulz

Aptos apuesta USD $50 millones a la AI y los mercados institucionales on-chain

Manfred, el Primer Agente de IA que Formó su Propia Empresa en EE.UU

Gador inaugura la primera planta de oligonucleótidos terapéuticos en Argentina y latam

CRISPR Parte I: Avances en Terapias Génicas con CRISPR para 2025 – Transformando la Medicina

Vercel: La Plataforma Líder en Desarrollo Web y AI Cloud

¡El Futuro es Ahora! Los Avances Más Impactantes en Hologramas para 2025

Aptos apuesta USD $50 millones a la AI y los mercados institucionales on-chain

Binance Lanza la Agentic Wallet: La Era de las Carteras Diseñadas para Agentes de IA

Midnight (NIGHT) Avanza en Abril 2026: Nuevos Proyectos de I+D, Bitcoin Yield Privado y Adopción Institucional

TENDENCIAS

-

Bio1 año ago

Bio1 año agoCRISPR Parte I: Avances en Terapias Génicas con CRISPR para 2025 – Transformando la Medicina

-

EmpresasTech5 meses ago

EmpresasTech5 meses agoVercel: La Plataforma Líder en Desarrollo Web y AI Cloud

-

Researchland1 año ago

Researchland1 año ago¡El Futuro es Ahora! Los Avances Más Impactantes en Hologramas para 2025

-

AI1 año ago

AI1 año ago¿Qué es Hugging Face? Guía Actualizada a Mayo 2025

-

Nano1 año ago

Nano1 año agoLas últimas innovaciones en nanotecnología

-

AI5 meses ago

AI5 meses agoGoogle Antigravity: La Herramienta IA Multiagentes que Revoluciona el Desarrollo de Software

-

AI1 año ago

AI1 año agoAgentes de IA y Workflows Agénticos: La Revolución de la Automatización

-

AI1 año ago

AI1 año agoAgentes de IA vs. Agentic AI : Diferencias, Ejemplos y Avances Recientes