Este hito marca el inicio de una nueva época para la computación. Para entender por qué este anuncio de Microsoft y Quantinuum es tan disruptivo, debemos desglosar los detalles técnicos, el funcionamiento de la corrección de errores y las implicaciones a largo plazo que transformarán industrias enteras.

La computación cuántica ha vivido durante décadas en la llamada «era NISQ» (Noisy Intermediate-Scale Quantum), donde los errores eran tan frecuentes que los cálculos complejos se desmoronaban antes de completarse. Sin embargo, el anuncio del 22 de abril de 2026 confirma que hemos cruzado el puente hacia la fiabilidad técnica.

1. El Problema de la Fragilidad: Qubits Físicos vs. Lógicos

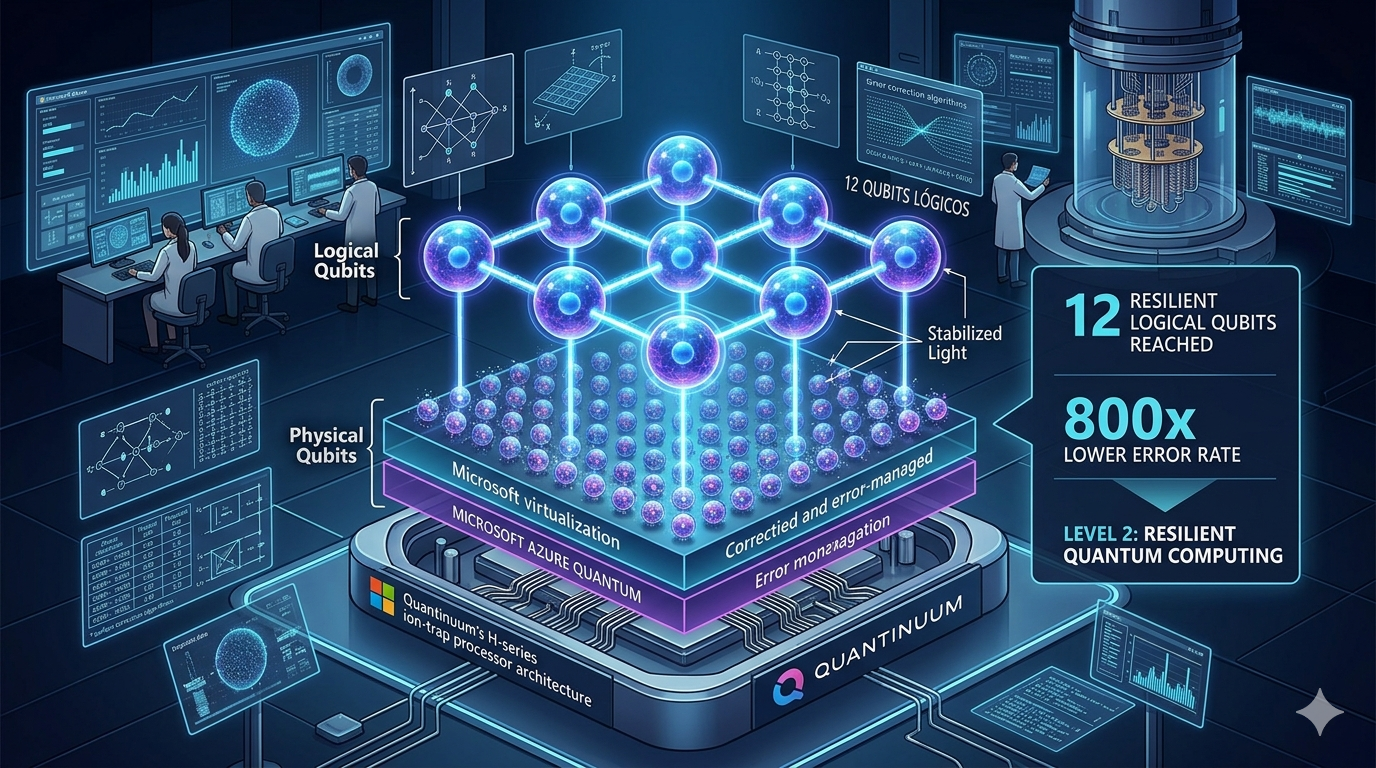

Para entender el avance, hay que diferenciar los tipos de qubits:

- Qubits Físicos: Son las unidades básicas (iones, fotones o circuitos superconductores). Son increíblemente inestables; cualquier mínima fluctuación térmica o electromagnética causa «decoherencia», perdiendo los datos.

- Qubits Lógicos: Son una abstracción de software. Se crean agrupando muchos qubits físicos y utilizando algoritmos de Corrección de Errores Cuánticos (QEC) para que actúen como una sola unidad estable.

El logro técnico: Microsoft y Quantinuum no solo han creado 12 de estos qubits lógicos, sino que han demostrado que pueden realizar operaciones entre ellos sin que los errores se propaguen. La tasa de error es 800 veces menor que la de los componentes físicos subyacentes, una mejora sin precedentes en la industria.

2. La Tecnología detrás del Hito: Trampas de Iones y Virtualización

El éxito es el resultado de la combinación de dos potencias tecnológicas:

El Hardware de Quantinuum (Serie H)

Utiliza la tecnología de trampa de iones de dispositivo de acoplamiento de carga (QCCD). A diferencia de otros sistemas, este permite que los qubits se muevan físicamente dentro del chip, facilitando una conectividad total («all-to-all connectivity»). Esto es vital para la corrección de errores, ya que permite que cualquier qubit interactúe con otro sin interferencias.

El Sistema de Orquestación de Microsoft

Microsoft ha aportado una capa de software de «virtualización de qubits». Este sistema monitorea los qubits físicos en tiempo real, detecta cuándo uno está a punto de fallar y corrige la información instantáneamente. Es, en esencia, un sistema operativo cuántico que gestiona el hardware de Quantinuum de forma inteligente.

3. El Paso al «Nivel 2»: Computación Cuántica Resiliente

Microsoft define tres etapas para la supercomputación cuántica:

- Nivel 1 (Fundacional): Basado en qubits físicos ruidosos. Útil para experimentos básicos pero incapaz de superar a la computación clásica en problemas reales.

- Nivel 2 (Resiliente): (Donde estamos ahora). Capacidad de operar con qubits lógicos que mantienen la información a pesar del ruido. Permite simulaciones científicas fiables.

- Nivel 3 (Escala Real): Computadoras con miles de qubits lógicos capaces de resolver los problemas más complejos del planeta (como el cambio climático o el descifrado de criptografía actual).

¿Por qué importan 12 qubits? Aunque parecen pocos comparados con los procesadores clásicos, el poder cuántico crece de forma exponencial. 12 qubits lógicos resilientes permiten empezar a ejecutar algoritmos de química cuántica que antes solo existían en papel.

4. Aplicaciones Prácticas: ¿En qué cambiará nuestras vidas?

Este avance no es solo para laboratorios; tiene aplicaciones industriales directas:

- Ciencia de Materiales: El descubrimiento de nuevos materiales suele ser por «ensayo y error». Con 12 qubits lógicos, podemos empezar a simular estructuras moleculares para crear paneles solares mucho más eficientes o superconductores a temperatura ambiente.

- El Problema de Haber-Bosch: La producción de fertilizantes consume el 1% de la energía mundial. La computación cuántica nivel 2 busca simular el proceso de la enzima nitrogenasa para crear fertilizantes de forma natural, reduciendo drásticamente las emisiones de CO2.

- Farmacología de Precisión: Modelar cómo una proteína se pliega ante un nuevo fármaco requiere una precisión que las computadoras clásicas no alcanzan. Este sistema reduce los años de investigación necesarios para sacar un medicamento al mercado.

5. Próximos Pasos: El Camino hacia los 100 Qubits Lógicos

El objetivo de la alianza es escalar este sistema. Si con 12 qubits ya se han superado las tasas de error de la competencia, el siguiente reto es alcanzar los 100 qubits lógicos. En ese punto, se estima que la computación cuántica alcanzará la ventaja científica definitiva, superando a cualquier supercomputadora clásica existente (como la Frontier de EE. UU.) en tareas específicas de física de partículas.

Fuentes y Enlaces de Interés:

Bio12 meses ago

Bio12 meses ago

Researchland12 meses ago

Researchland12 meses ago

EmpresasTech5 meses ago

EmpresasTech5 meses ago

AI12 meses ago

AI12 meses ago

Nano1 año ago

Nano1 año ago

AI5 meses ago

AI5 meses ago

AI1 año ago

AI1 año ago

AI1 año ago

AI1 año ago