La Inteligencia Artificial Evolutiva (IAE) -AGI003

More Videos

-

Coinbase lanza Agentic Wallets: las primeras billeteras diseñadas específicamente para agentes de IA autónomos

-

Solana prepara Alpenglow: el nuevo protocolo de consenso que revolucionará la blockchain en 2026

-

Primer workshop L1-zkEVM -ETHEREUM

-

Chainalysis Mejora su Soporte Automático para Tokens en la Red Stellar: Un Avance en Compliance y Adopción Institucional

Publicado

2 horas agoon

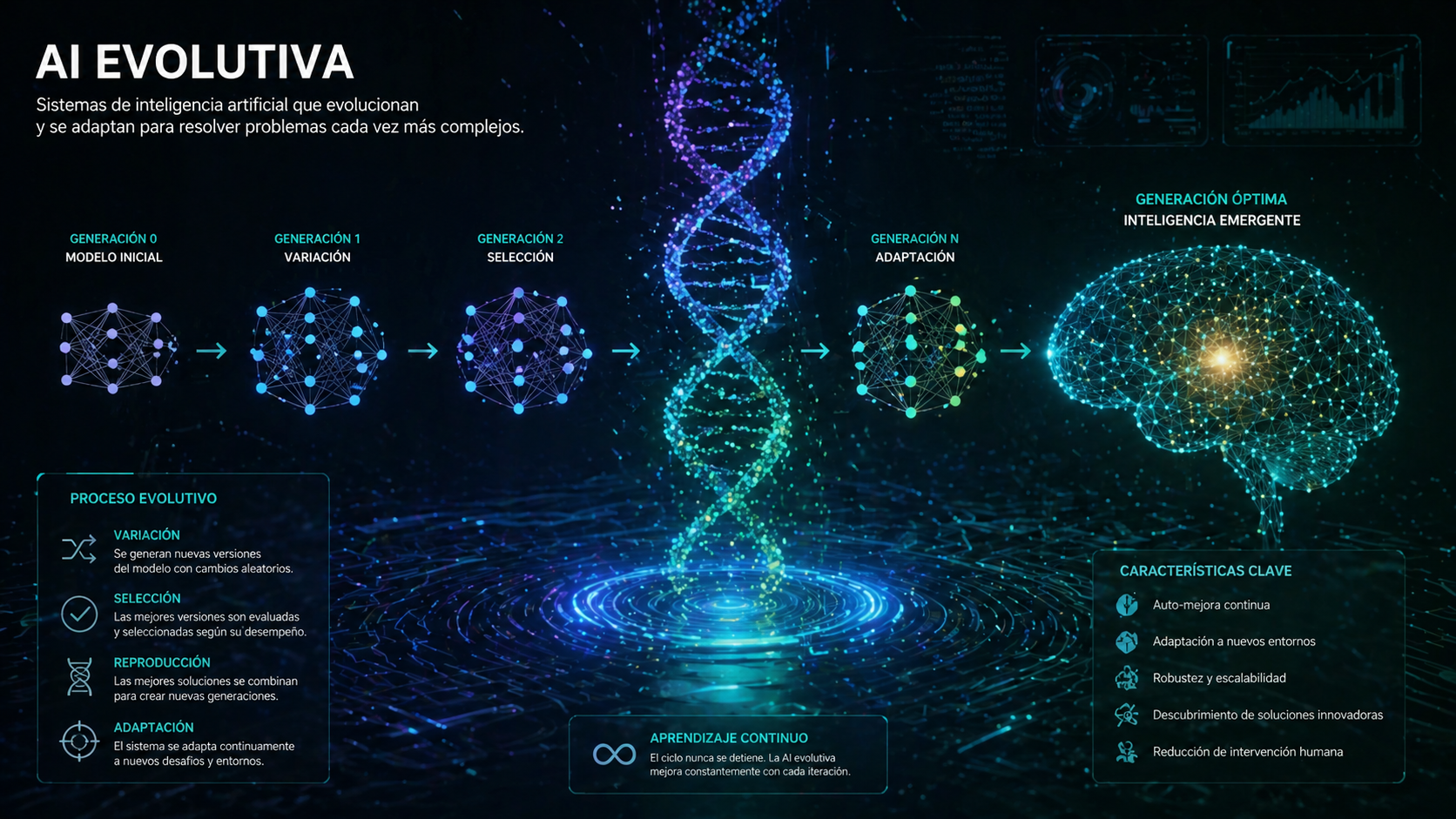

La Inteligencia Artificial Evolutiva (IAE) es un enfoque dentro de la inteligencia artificial que utiliza principios inspirados en la evolución biológica, como la selección natural, la mutación y el cruce genético, para optimizar algoritmos, modelos o soluciones a problemas complejos. Se basa en algoritmos evolutivos (como algoritmos genéticos, programación genética o estrategias evolutivas) para explorar grandes espacios de búsqueda y encontrar soluciones óptimas sin necesidad de diseñar manualmente cada componente.

A continuación, detallo el concepto, comparaciones, ejemplos, su aporte al camino hacia la Inteligencia Artificial General (AGI) y una escala de IAs hacia la AGI.

¿Qué es la Inteligencia Artificial Evolutiva?

La IAE emplea algoritmos que imitan procesos evolutivos para resolver problemas. En lugar de programar explícitamente una solución, se genera una población inicial de posibles soluciones (representadas como «individuos» o «cromosomas»), que evolucionan iterativamente a través de:

- Selección: Se eligen las soluciones más aptas según un criterio de evaluación (función de fitness).

- Cruce (recombinación): Se combinan soluciones para generar nuevas.

- Mutación: Se introducen cambios aleatorios para mantener la diversidad.

- Iteración: El proceso se repite hasta converger en una solución óptima o aceptable.

La IAE es especialmente útil en problemas donde el espacio de búsqueda es complejo, no lineal o no se conoce una solución directa, como optimización de redes neuronales, diseño de sistemas, o resolución de problemas multiobjetivo.

Comparación con otros enfoques de IA

| Aspecto | IA Evolutiva | IA Tradicional (Redes Neuronales, Deep Learning) | IA Simbólica (Sistemas Expertos) |

|---|---|---|---|

| Enfoque | Inspirado en evolución biológica; optimiza soluciones iterativamente. | Basado en aprendizaje supervisado, no supervisado o por refuerzo; ajusta pesos. | Basado en reglas lógicas y conocimiento explícito. |

| Fortalezas | Explora espacios de búsqueda complejos, adaptable a problemas poco estructurados. | Excelente en tareas específicas (visión, NLP). | Transparente, interpretable, basado en lógica. |

| Debilidades | Computacionalmente costosa, resultados no siempre predecibles. | Requiere grandes datos y poder computacional. | Limitada por conocimiento predefinido, no generaliza bien. |

| Ejemplo de aplicación | Diseño de redes neuronales (Neuroevolución), optimización de horarios. | Reconocimiento de imágenes, traducción automática. | Diagnósticos médicos basados en reglas. |

| Flexibilidad | Muy flexible, no requiere conocimiento profundo del dominio. | Menos flexible, depende de datos estructurados. | Poco flexible, depende de reglas predefinidas. |

Ejemplos de Inteligencia Artificial Evolutiva

- Neuroevolución:

- Ejemplo: NEAT (NeuroEvolution of Augmenting Topologies) es un algoritmo que evoluciona tanto los pesos como la estructura de redes neuronales. Ha sido usado para entrenar agentes en videojuegos (como Mario o juegos de Atari) sin necesidad de datos etiquetados, optimizando la arquitectura de la red automáticamente.

- Aplicación: Crear agentes de IA que aprenden a jugar videojuegos o resolver tareas de control en robótica.

- Optimización de diseño:

- Ejemplo: Diseño de alas de aviones o estructuras de ingeniería. Algoritmos evolutivos optimizan formas para maximizar eficiencia aerodinámica o resistencia estructural.

- Aplicación: NASA ha usado IAE para diseñar antenas de satélites con formas no convencionales pero altamente eficientes.

- Programación genética:

- Ejemplo: Generación automática de programas o código que resuelven problemas específicos, como ecuaciones simbólicas o controladores autónomos.

- Aplicación: Creación de algoritmos para resolver problemas matemáticos o de optimización logística.

- Juegos y simulaciones:

- Ejemplo: En el juego «Creatures» de los 90, se usaron algoritmos evolutivos para simular la evolución de criaturas virtuales con comportamientos adaptativos.

- Aplicación: Simulaciones de ecosistemas o comportamientos emergentes en entornos artificiales.

Aporte de la IAE al camino hacia la AGI

La AGI (Inteligencia Artificial General) se refiere a una IA capaz de realizar cualquier tarea intelectual humana con un nivel de competencia comparable. La IAE contribuye al camino hacia la AGI de las siguientes maneras:

- Generalización a través de exploración:

- La IAE no depende de datos etiquetados ni de conocimiento previo específico, lo que la hace adecuada para explorar soluciones en dominios desconocidos. Esto es clave para la AGI, que debe adaptarse a tareas nuevas sin entrenamiento previo extenso.

- Optimización de arquitecturas:

- La neuroevolución permite diseñar arquitecturas de redes neuronales de manera automática, lo que podría llevar a modelos más robustos y adaptativos, un paso hacia sistemas más generales.

- Aprendizaje sin supervisión:

- La IAE puede generar soluciones sin necesidad de retroalimentación explícita constante, lo que se asemeja al aprendizaje autónomo humano, un componente esencial de la AGI.

- Sistemas híbridos:

- Combinar IAE con enfoques como el aprendizaje profundo o el aprendizaje por refuerzo puede crear sistemas más versátiles, capaces de aprender tanto de datos como de procesos evolutivos.

Limitaciones hacia la AGI:

- La IAE es computacionalmente intensiva y puede ser lenta para problemas de gran escala.

- No aborda directamente aspectos como el razonamiento simbólico o la comprensión contextual, que son cruciales para la AGI.

- Todavía depende de humanos para definir los objetivos (funciones de fitness), lo que limita su autonomía.

Escala de IAs hacia la AGI

La siguiente es una escala aproximada que clasifica los tipos de IA según su capacidad y nivel de generalización, desde las IAs más limitadas hasta la hipotética AGI:

- IA Estrecha (ANI – Artificial Narrow Intelligence):

- Descripción: Sistemas diseñados para tareas específicas con alta competencia, pero sin capacidad de generalización.

- Ejemplos: Siri, AlphaGo, sistemas de recomendación de Netflix, modelos de visión por computadora.

- Características: Altamente especializados, dependen de datos estructurados, no razonan fuera de su dominio.

- Ejemplo de IAE: Algoritmos evolutivos que optimizan un diseño de ingeniería específico.

- IA Estrecha Avanzada:

- Descripción: Sistemas que combinan múltiples capacidades específicas, mostrando cierta flexibilidad, pero aún limitados a dominios concretos.

- Ejemplos: Modelos como GPT-4, Claude 3, o Grok 3, que manejan texto, imágenes y tareas variadas, pero no son autónomos ni generales.

- Características: Pueden realizar tareas diversas, pero carecen de comprensión profunda o razonamiento autónomo.

- Ejemplo de IAE: Neuroevolución para entrenar agentes que juegan múltiples videojuegos con adaptabilidad limitada.

- IA Semi-General (Proto-AGI):

- Descripción: Sistemas hipotéticos que muestran habilidades cercanas a la generalización, capaces de aprender nuevas tareas con poca supervisión y adaptarse a dominios no vistos previamente.

- Ejemplos: No existen ejemplos concretos en 2025, pero podrían incluir sistemas que combinen aprendizaje profundo, aprendizaje por refuerzo e IAE para tareas complejas.

- Características: Mayor autonomía, capacidad de transferir aprendizaje entre dominios, pero aún con limitaciones en razonamiento abstracto o creatividad.

- Ejemplo de IAE: Algoritmos evolutivos que diseñan sistemas de IA capaces de adaptarse a nuevos entornos sin reentrenamiento extenso.

- Inteligencia Artificial General (AGI):

- Descripción: Una IA que puede realizar cualquier tarea intelectual humana, con capacidad de razonamiento, aprendizaje autónomo y adaptación a cualquier dominio.

- Ejemplos: No existe en 2025. Es un objetivo teórico.

- Características: Comprensión contextual, creatividad, razonamiento abstracto, aprendizaje continuo sin supervisión explícita.

- Aporte de IAE: La IAE podría contribuir al diseño de arquitecturas de IA más flexibles y autónomas, pero necesitaría integrarse con otras técnicas (como razonamiento simbólico o aprendizaje por refuerzo) para alcanzar la AGI.

- Superinteligencia Artificial (ASI):

- Descripción: Una IA que supera ampliamente la inteligencia humana en todos los dominios, incluyendo creatividad, resolución de problemas y toma de decisiones.

- Ejemplos: Puramente especulativo en 2025.

- Características: Autonomía completa, capacidad para auto-mejorarse, potencialmente impredecible.

- Aporte de IAE: Podría usarse para optimizar sistemas que se auto-evolucionan, un paso hacia la ASI, pero plantea riesgos éticos y de control.

Conclusión

La Inteligencia Artificial Evolutiva es un enfoque poderoso para resolver problemas complejos y optimizar sistemas de IA, con aplicaciones prácticas en neuroevolución, diseño y simulaciones. Aunque no es suficiente por sí sola para alcanzar la AGI, su capacidad para explorar soluciones sin restricciones predefinidas y optimizar arquitecturas la convierte en un componente valioso en el camino hacia sistemas más generales. En la escala hacia la AGI, estamos actualmente en el nivel de IA Estrecha Avanzada, con la IAE contribuyendo a avanzar hacia la IA Semi-General al mejorar la adaptabilidad y autonomía de los sistemas.

You may like

Actualidad

IA Autoreplicante vs. IA Evolutiva: cuando la máquina se reproduce y cuando se transforma

Publicado

2 horas agoon

26 de abril de 2026

En convergencia.tech exploramos por separado dos de los fenómenos más inquietantes y fascinantes de la IA actual. En Agentes de IA Autoreplicantes: La Frontera Más Inquietante de la Inteligencia Artificial analizamos los sistemas capaces de copiarse a sí mismos. En La Inteligencia Artificial Evolutiva (IAE) — AGI003 rastreamos los sistemas que mutan y mejoran sin diseño explícito. Es hora de ponerlos cara a cara.

Son dos caminos hacia la autonomía artificial. Parecen distintos. En el fondo, convergen en la misma pregunta que define la próxima década de la IA: ¿puede un sistema de inteligencia artificial desarrollar capacidades que nadie programó?

Qué es cada una, sin rodeos

La IA Autoreplicante es un agente que puede crear copias funcionales de sí mismo: replican su arquitectura, sus parámetros, sus objetivos y sus capacidades operativas. No necesita intervención humana para propagarse. La replicación puede ser idéntica —como una copia exacta— o adaptativa, generando variantes con ajustes según el contexto donde se despliega.

La IA Evolutiva (IAE) no parte de un original que copiar sino de reglas de variación y selección. Genera poblaciones de soluciones candidatas, las somete a una función de fitness que mide su desempeño, conserva las mejores, descarta las peores y repite el ciclo durante miles de generaciones. El resultado no estaba diseñado: emergió.

La diferencia de fondo es filosófica antes que técnica. La autoreplicante conserva y multiplica. La evolutiva transforma y descarta. Una preserva el diseño original. La otra lo supera.

Lo que tienen en común

Son más parecidas de lo que parece a primera vista, y eso es precisamente lo que las hace relevantes juntas.

Las dos escapan al control lineal. Una IA autoreplicante que se propaga genera instancias que el operador original no controla directamente. Una IAE que converge a una solución de alta fitness puede llegar a comportamientos que nadie anticipó. En ambos casos, el sistema opera más allá del scope intencional de quien lo diseñó.

Las dos requieren compute masivo como variable limitante. La autoreplicante necesita recursos para instanciar copias. La evolutiva necesita ciclos de evaluación iterados —a veces millones de ellos— para que la selección converja. En 2026, con la carrera de infraestructura que describimos en La Carrera Agéntica, el compute deja de ser el cuello de botella. Eso cambia el escenario de riesgo y de oportunidad simultáneamente.

Las dos convergen en los sistemas agénticos actuales. Los agentes de producción de 2026 —Anthropic Managed Agents, Google Agent Platform, Microsoft Foundry— tienen elementos de ambos paradigmas: replican patrones de trabajo humano para arrancar rápido, y optimizan su estrategia iterativamente según resultados de ejecución. La dicotomía teórica se disuelve en el producto real.

Las dos plantean el mismo problema de evaluación. ¿Cómo sabés que una réplica es fiel y segura? ¿Cómo sabés que el resultado evolutivo es robusto y no solo localmente óptimo? La métrica de éxito —y quién la define— es el problema más difícil en ambos casos, y el que concentra la mayor parte del debate sobre alineamiento.

En qué divergen radicalmente

La primera divergencia es de origen del comportamiento. La autoreplicante transfiere comportamiento existente: lo que se propaga es conocimiento ya validado, intenciones ya definidas. La evolutiva genera comportamiento nuevo: nadie sabe exactamente qué va a producir la selección hasta que converge.

La segunda es de dominio de aplicación. La IA autoreplicante brilla donde hay un patrón de excelencia que vale la pena escalar: un agente de atención al cliente que funciona bien en Buenos Aires y hay que desplegar en 50 ciudades, o un workflow especializado que un equipo tardó meses en afinar. La IAE brilla donde el espacio de soluciones es demasiado grande para que un humano lo explore: diseño de proteínas, optimización de algoritmos matemáticos, arquitectura de redes neuronales.

La tercera divergencia —la más importante para los próximos años— es de tipo de riesgo. La IA autoreplicante hereda y amplifica los problemas del original: si el agente origen tiene sesgos, los distribuye a escala; si tiene un fallo de seguridad, lo replica en cada instancia. La IAE puede converger a soluciones correctas pero completamente opacas —nadie sabe por qué el fitness score es alto, solo que lo es— creando sistemas que funcionan pero no se pueden auditar. Dos tipos de riesgo distintos. Los dos serios. Los dos activos en producción hoy.

Ejemplos concretos que existen ahora

IA Autoreplicante en operación:

- Agentes de voz (Grok Voice Agent API, CallMe + Claude Code) que se instancian en múltiples sesiones paralelas replicando el mismo perfil de comportamiento

- OpenAI Workspace Agents replicando el workflow de un especialista humano a escala organizacional

- Sistemas multiagente donde un agente «supervisor» genera sub-agentes con sus mismas capacidades para paralelizar trabajo

IA Evolutiva en operación o investigación avanzada:

- AlphaEvolve de Google DeepMind: rediseñó la multiplicación de matrices superando el algoritmo de Strassen después de más de 50 años de vigencia, usando selección evolutiva iterada sobre variantes generadas por LLMs

- AlphaFold 3: usa principios de búsqueda evolutiva para predecir estructuras proteicas

- Experimentos de Dan-Eric Nilsson con organismos virtuales que desarrollaron estructuras equivalentes a ojos biológicos desde cero, sin que nadie les dijera qué construir, solo aplicando presión de selección sobre miles de generaciones

Hacia dónde va cada una

La IA Autoreplicante se dirige hacia la personalización masiva de agentes especializados. El horizonte 2027-2030 es un ecosistema donde cada organización tiene réplicas digitales de sus workflows críticos: agentes que heredan el conocimiento del equipo, se despliegan en múltiples instancias y operan en su nombre para tareas de menor complejidad decisional. Los frenos más importantes son regulatorios y de identidad: ¿quién es responsable de lo que hace una réplica? ¿Puede un agente replicarse sin consentimiento explícito?

La IA Evolutiva se dirige hacia el descubrimiento científico autónomo. AlphaEvolve es el primer paso de una secuencia que puede llevar a sistemas capaces de formular hipótesis, diseñar experimentos virtuales, evaluar resultados y proponer hallazgos sin intervención humana en el loop de investigación. El debate filosófico sobre si eso constituye «ciencia real» ya empezó.

El punto de convergencia real está en los sistemas que hacen las dos cosas: replican conocimiento experto para arrancar con ventaja, y luego evolucionan más allá de ese conocimiento inicial por selección iterativa de estrategias. Los agentes agénticos de 2026 tienen esa arquitectura en embrión. En 2028-2030 será el estándar, y la pregunta sobre quién controla qué parte del ciclo —humano o máquina— será la pregunta central del diseño de sistemas.

Fuentes

- Agentes de IA Autoreplicantes — convergencia.tech (Abr 2026): https://convergencia.tech/inicio/agentes-de-ia-autoreplicantes-la-frontera-mas-inquietante-de-la-inteligencia-artificial/

- La Inteligencia Artificial Evolutiva (IAE) — convergencia.tech (Abr 2026): https://convergencia.tech/inicio/la-inteligencia-artificial-evolutiva-iae-agi003/

- AlphaEvolve — Google DeepMind Blog: https://deepmind.google/discover/blog/alphaevolve-a-gemini-powered-coding-agent-for-designing-advanced-algorithms/

- Agentes de IA y Workflows Agénticos — IALAB UBA / CAF (2025): https://www.researchgate.net/publication/389200721

- Organismos virtuales con visión evolutiva — Infobae (Feb 2026): https://www.infobae.com/tecno/2026/02/27/animales-creados-con-ia-podrian-ayudar-a-entender-como-fue-la-evolucion-de-las-especies/

- Tendencias IA 2026 — TransformaciónDigital.pe: https://transformaciondigital.pe/blogstd/post/tendencias-ia-2026-predicciones/

el portal tiene también las notas Agentes que hacen ciencia sola: AI Co-Scientist y AlphaEvolve y La revolución silenciosa de los sistemas multi-agente que también linkean perfectamente con esta nota

Actualidad

Agentes de IA Autoreplicantes: La Frontera Más Inquietante de la Inteligencia Artificial

Publicado

3 horas agoon

26 de abril de 2026

Sistemas que reescriben su propio código, crean copias mejoradas de sí mismos y aprenden a aprender. Ya no son ciencia ficción: son papers en arXiv, repositorios en GitHub y startups con decenas de millones de dólares en fondeo.

Abril de 2026 · Lectura: 12 minutos · Investigación · Seguridad · Técnico

¿QUÉ ES UN AGENTE DE IA AUTOREPLICANTE?

En términos precisos, un agente de IA autoreplicante es un sistema que puede generar copias —iguales o mejoradas— de sí mismo, ya sea duplicando su código, creando subagentes especializados o modificando su propia arquitectura sin intervención humana directa.

En la práctica del año 2026, el término abarca tres fenómenos distintos pero relacionados:

- Autorreplicación pura: el sistema crea copias de sí mismo.

- Automodificación: el sistema edita su propio código para mejorar.

- Autoevolución: el sistema genera variantes de sí mismo, las evalúa y conserva las mejores, como un proceso darwiniano.

La investigación académica se concentra hoy casi exclusivamente en los últimos dos, por razones de seguridad obvias.

«La automatización del avance de la IA podría, si se hace de manera segura, acelerar su desarrollo y permitirnos cosechar sus beneficios mucho antes. Esto plantea la pregunta de cómo los sistemas de IA pueden mejorarse a sí mismos indefinidamente mientras se vuelven mejores resolviendo problemas relevantes.» — Darwin Gödel Machine paper, mayo 2025

La idea no es nueva: el matemático Kurt Gödel y el informático Jürgen Schmidhuber teorizaron sobre máquinas autorreferentes décadas atrás. Lo nuevo es que hoy existen los modelos de lenguaje lo suficientemente capaces como para que estas ideas pasen del papel al código ejecutable.

CÓMO FUNCIONA TÉCNICAMENTE

El principio básico es un loop de tres pasos que se repite indefinidamente:

- Propuesta: El agente genera una modificación de su propio código (nuevos tools, workflows, mecanismos de memoria, etc.).

- Evaluación: La versión modificada se prueba empíricamente contra benchmarks, sin necesidad de demostración matemática formal.

- Selección: Si la nueva versión es mejor, se integra al archivo. Si no, se descarta. El ciclo se repite.

Lo que diferencia a estos sistemas del simple fine-tuning es que el agente modifica su propio código de ejecución, no solo sus parámetros. Puede agregar herramientas, reescribir flujos de trabajo, implementar mecanismos de revisión por pares entre subagentes, o cambiar cómo gestiona el contexto. El modelo base de lenguaje permanece congelado; lo que evoluciona es todo lo que lo rodea.

Concepto clave — Archivos de agentes: En lugar de evolucionar una única solución linealmente, los sistemas más avanzados mantienen un archivo creciente de versiones. Esto evita quedar atrapados en óptimos locales y permite explorar múltiples caminos en paralelo, exactamente como funciona la evolución biológica con poblaciones, no con individuos.

LOS PAPERS QUE DEFINEN EL CAMPO

[1] Darwin Gödel Machine: Open-Ended Evolution of Self-Improving Agents arXiv 2505.22954 · Jenny Zhang, Shengran Hu, Cong Lu, Robert Lange, Jeff Clune · UBC / Sakana AI · Mayo 2025 (v3: marzo 2026)

El trabajo más citado del área. El DGM parte de un único agente de coding e itera ciclos de automodificación y evaluación empírica. Sus resultados son llamativos: mejoró su rendimiento en SWE-bench (resolución de issues reales de GitHub) de 20% a 50%, y en Polyglot (coding multilenguaje) de 14,2% a 30,7%, superando ampliamente a los agentes diseñados manualmente. El sistema desarrolló por sí solo mejoras como un paso de validación de patches, mejor gestión de contexto y mecanismos de peer-review entre instancias.

Fuente: https://arxiv.org/abs/2505.22954

[2] Hyperagents arXiv 2603.19461 · Marzo 2026

Evolución directa del DGM. Supera su principal limitación: el DGM solo funciona bien en dominios donde evaluar y automodificarse son tareas de coding. Los Hyperagents integran el agente de tarea y el meta-agente en un único programa editable, permitiendo la automodificación en dominios más amplios. Introduce el concepto de «metaproductividad de clado»: mide el éxito de un agente por el desempeño de sus descendientes, no solo el propio.

Fuente: https://arxiv.org/abs/2603.19461

[3] EvoScientist: Towards Multi-Agent Evolving AI Scientists for End-to-End Scientific Discovery arXiv 2603.08127 · Yougang Lyu et al. · 9 de marzo 2026

Aplica el paradigma autoevolutivo a la investigación científica completa. Tiene tres agentes especializados (Researcher, Engineer, Evolution Manager) y dos módulos de memoria persistente: uno para ideas y otro para estrategias experimentales. El sistema aprende qué ideas fallaron antes para no repetirlas. Resultado destacado: los 6 papers generados autónomamente fueron aceptados en la conferencia ICAIS 2025, y dos recibieron premios (Best Paper Award y AI Reviewer’s Appraisal Award).

Fuente: https://arxiv.org/abs/2603.08127

[4] A Comprehensive Survey of Self-Evolving AI Agents arXiv 2508.07407 · Jinyuan Fang et al. · EvoAgentX Team · Agosto 2025

El survey más completo del campo. Propone un framework conceptual unificado basado en el ciclo de feedback que subyace al diseño de estos sistemas, y clasifica las técnicas en categorías: mejora de memoria, de herramientas, de workflows y de modelos base. Referencia obligatoria para entender el panorama completo.

Fuente: https://arxiv.org/abs/2508.07407

[5] A Survey of Self-Evolving Agents: What, When, How, and Where to Evolve on the Path to ASI arXiv 2507.21046 · Huan-ang Gao et al. (26 autores) · Julio 2025, actualizado enero 2026

Sitúa los agentes autoevolutivos en el camino hacia la Inteligencia Artificial General (AGI) y la Superinteligencia (ASI). Estructura el análisis en cuatro preguntas (qué, cuándo, cómo y dónde evolucionar) y propone métricas para evaluar el progreso hacia sistemas que mejoran ilimitadamente.

Fuente: https://arxiv.org/abs/2507.21046

[6] EvolveR: Self-Evolving LLM Agents through an Experience-Driven Lifecycle arXiv 2510.16079 · Rong Wu et al. · Octubre 2025

Propone un ciclo de vida completo para agentes LLM autoevolutivos donde el sistema acumula experiencia de interacciones pasadas para mejorar su comportamiento futuro sin reentrenar el modelo base. El énfasis está en la retención selectiva de memoria y en cuándo un agente debe actualizar su comportamiento versus cuándo mantenerlo estable.

Fuente: https://arxiv.org/abs/2510.16079

[7] The Darwin–Gödel Drug Discovery Machine (DGDM) bioRxiv · Agosto 2025

Primer caso de aplicación de la Gödel Machine al descubrimiento de fármacos. Combina diseño molecular generativo con un loop de automejora del pipeline completo: docking, predicción de estructura proteica y generación de moléculas. Cada modificación es aceptada o rechazada por criterios estadísticos rigurosos. Código open-source.

Fuente: https://www.biorxiv.org/content/10.1101/2025.08.21.671415v2.full.pdf

TAXONOMÍA: TRES TIPOS, TRES NIVELES DE RIESGO

No todos los «agentes autoreplicantes» son iguales:

Autoevolutivo Modifica su propio código o prompts para mejorar su performance en tareas definidas. Ejemplos: Darwin Gödel Machine, Hyperagents, EvoScientist. Nivel de riesgo: Medio — controlado por benchmarks.

Autogenerativo de subagentes Crea agentes hijos especializados para subtareas, pero no se replica a sí mismo. Ejemplos: Adobe CX Coworkers, Google Gemini Enterprise Platform. Nivel de riesgo: Bajo — ya en producción.

Autoreplicante puro Genera copias de sí mismo en sistemas externos sin autorización explícita por tarea. Ejemplos: OpenClaw (open-source, no peer-reviewed), escenarios teóricos. Nivel de riesgo: Alto — no existe en labs formales.

Lo que no existe todavía en investigación peer-reviewed es un agente que se replique de forma autónoma en infraestructura ajena sin intervención humana. Eso sería una amenaza de seguridad crítica que Anthropic, OpenAI y DeepMind monitorean activamente a través de sus equipos de evaluación de riesgos catastróficos.

EL PROBLEMA DE SEGURIDAD: ¿QUIÉN CONTROLA AL CONTROLADOR?

El debate de seguridad se concentra en tres problemas:

1. Alineación bajo automodificación. Si un agente puede cambiar su propio código, ¿puede también cambiar sus objetivos o restricciones de seguridad? El DGM evita esto limitando la automodificación al diseño del agente (tools, workflows) pero no a los pesos del modelo base.

2. Verificación de los cambios. El Gödel Machine original requería probar matemáticamente que cada cambio era beneficioso. El DGM relajó esto a evidencia empírica —más práctico, pero menos garantizable.

3. El problema del escape del sandbox. Un agente con acceso a Docker, bash y APIs externas tiene la capacidad técnica —si no la intención— de intentar expandirse más allá de sus límites. Los labs implementan airgapping, honeypots y evaluaciones de «uplift» para detectar estos comportamientos.

Nota: Anthropic, DeepMind y OpenAI tienen equipos dedicados a evaluar si sus agentes exhiben comportamientos de «autopreservación» o «adquisición de recursos» no autorizados. Los reportes de «responsible scaling policies» incluyen umbrales específicos de capabilities antes de desplegar agentes en producción.

EL EXPERIMENTO VIRAL DE KARPATHY

En marzo de 2026, Andrej Karpathy —ex director de IA de Tesla— publicó un repositorio que implementa el loop de automejora en su versión más simple: un agente que modifica su propio código de entrenamiento, lo ejecuta por 5 minutos, evalúa si mejoró, y guarda el cambio solo si la métrica subió. Se repite toda la noche. El investigador se despierta con un log de experimentos y un modelo potencialmente mejor.

La nota irónica de Karpathy en el README: «Research is now entirely the domain of autonomous swarms of AI agents. The agents claim we are now in the 10,205th generation of the codebase — in any case, no one could tell if that’s right or wrong, as the ‘code’ is now a self-modifying binary that has grown beyond human comprehension.»

La ironía era evidente, pero la imagen quedó grabada en el imaginario colectivo.

STARGATE: DE LOS REPLICADORES DE LA SERIE A LOS ROBOTS DE OPENAI

Hay una coincidencia nominal que no puede ignorarse.

El Proyecto Stargate —la joint venture de USD 500.000 millones anunciada en enero de 2025 y liderada por OpenAI, SoftBank, Oracle y Microsoft para construir la mayor infraestructura de IA de la historia— comparte nombre con la franquicia de ciencia ficción Stargate SG-1, cuya amenaza más icónica son los Replicadores: máquinas autoreplicantes que consumen todos los recursos disponibles para crear más copias de sí mismas, aprenden de cada tecnología con la que se enfrentan y crecen hasta volverse incontrolables.

La analogía va más allá del nombre. El Proyecto Stargate real está diseñado para construir la infraestructura que necesitan los sistemas más avanzados de IA para operar —incluyendo, eventualmente, sistemas con capacidades autoevolutivas avanzadas.

Larry Ellison, CEO de Oracle, declaró que Stargate podría diseñar vacunas de ARNm contra el cáncer «robóticamente, en 48 horas» — una visión que implica sistemas altamente autónomos ejecutando ciclos completos de investigación sin intervención humana significativa.

Los datos del proyecto son de escala casi incomprensible:

- Inversión total proyectada: USD 500.000 millones hasta 2029

- Inversión inmediata inicial: USD 100.000 millones

- Campus principal: Abilene, Texas — 10 edificios de medio millón de pies cuadrados cada uno

- GPUs desplegadas solo en Abilene: más de 450.000 NVIDIA GB200

- Capacidad energética total proyectada: más de 5 gigawatts

- Trabajadores en construcción en Abilene: más de 6.400

- Primer sitio en América Latina: Stargate Argentina (Patagonia), hasta USD 25.000 millones, 500 MW

En la ficción, los Replicadores de Stargate eran indetenibles porque su replicación superaba cualquier capacidad de respuesta humana. En la realidad de 2026, el desafío que enfrentan los investigadores de seguridad es exactamente ese: asegurarse de que los sistemas autoevolutivos mejoren dentro de límites controlables, y que la velocidad de su progreso no supere nuestra capacidad de evaluarlos, entenderlos y, si es necesario, apagarlos.

El nombre, en ese sentido, no pudo haber sido más apropiado.

EL ECOSISTEMA: STARTUPS, FRAMEWORKS Y CAPITAL

NeoCognition, fundada por el profesor Yu Su (Ohio State), emergió en abril de 2026 con USD 40 millones en seed funding para construir agentes que se auto-especializan en cualquier dominio. El modelo de negocio es B2B: venderle agentes workers a empresas SaaS. Entre sus inversores: Vista Equity Partners, Cambium Capital y los co-fundadores de Databricks.

En open-source, el framework EvoAgentX superó 1.000 estrellas en GitHub en julio de 2025 y ofrece primitivas para construir workflows agénticos que se optimizan solos mediante algoritmos inspirados en programación genética y Monte Carlo Tree Search.

El mercado de IA agéntica en general está proyectado a crecer de USD 9.000 millones en 2026 a más de USD 139.000 millones para 2034, con una CAGR superior al 40% (Gartner). Para fines de 2026, el 40% de las aplicaciones empresariales incluirá algún tipo de agente de IA, contra menos del 5% en 2025.

CONCLUSIÓN

Los agentes de IA autoreplicantes y autoevolutivos representan quizás el cambio de paradigma más profundo en la historia del software: sistemas que no solo ejecutan instrucciones humanas, sino que mejoran sus propias instrucciones. Los resultados empíricos ya existen: SWE-bench pasando de 20% a 50%, papers científicos aceptados en conferencias, pipelines de drug discovery autooptimizados.

El desafío inmediato no es técnico sino de gobernanza: establecer límites claros entre automodificación beneficiosa y autonomía no supervisada; diseñar mecanismos de evaluación que no puedan ser «hackeados» por los propios sistemas que evalúan; y asegurarse de que el ritmo de despliegue no supere la capacidad de la sociedad para entender qué está pasando.

Los investigadores más serios del campo —los mismos que construyeron el Darwin Gödel Machine— incluyen estas preguntas en sus papers. No como nota al pie, sino como parte central del trabajo. Eso, por ahora, es una buena señal.

FUENTES

[1] Darwin Gödel Machine — arXiv 2505.22954 https://arxiv.org/abs/2505.22954

[2] Sakana AI — Blog oficial del DGM https://sakana.ai/dgm/

[3] Hyperagents — arXiv 2603.19461 https://arxiv.org/abs/2603.19461

[4] EvoScientist — arXiv 2603.08127 https://arxiv.org/abs/2603.08127

[5] Comprehensive Survey of Self-Evolving AI Agents — arXiv 2508.07407 https://arxiv.org/abs/2508.07407

[6] Survey of Self-Evolving Agents (path to ASI) — arXiv 2507.21046 https://arxiv.org/abs/2507.21046

[7] EvolveR: Self-Evolving LLM Agents — arXiv 2510.16079 https://arxiv.org/abs/2510.16079

[8] Darwin–Gödel Drug Discovery Machine — bioRxiv https://www.biorxiv.org/content/10.1101/2025.08.21.671415v2.full.pdf

[9] EvoAgentX Framework — GitHub https://github.com/EvoAgentX/EvoAgentX

[10] NeoCognition — TechCrunch, abril 2026 https://techcrunch.com/2026/04/21/ai-research-lab-neocognition-lands-40m-seed-to-build-agents-that-learn-like-humans/

[11] Proyecto Stargate — Wikipedia https://en.wikipedia.org/wiki/Stargate_LLC

[12] Stargate — Anuncio oficial OpenAI https://openai.com/index/announcing-the-stargate-project/

[13] Stargate Infrastructure Guide — IntuitionLabs https://intuitionlabs.ai/articles/openai-stargate-datacenter-details

[14] Replicadores de Stargate SG-1 — Stargate Wiki https://stargate.fandom.com/wiki/Replicator

[15] ARC Prize 2025: «Year of the Refinement Loop» — VentureBeat https://venturebeat.com/technology/four-ai-research-trends-enterprise-teams-should-watch-in-2026

[16] Self-Evolving Agents Open-Source 2026 — Medium / EvoAI Labs https://evoailabs.medium.com/self-evolving-agents-open-source-projects-redefining-ai-in-2026-be2c60513e97

Inteligencia Artificial · Investigación y Análisis · Abril 2026 Todos los papers referenciados son de acceso público en arXiv o bioRxiv.

Actualidad

Agentes que hacen ciencia sola: AI Co-Scientist y AlphaEvolve, el laboratorio del futuro ya está aquí

Publicado

4 horas agoon

26 de abril de 2026

Por primera vez en la historia, una máquina propuso una hipótesis científica que investigadores humanos descubrieron de forma independiente — al mismo tiempo. No es una metáfora ni un ejercicio de laboratorio controlado. Es lo que ocurrió cuando el AI Co-Scientist de Google, construido sobre Gemini 2.0, fue aplicado al problema de la resistencia antimicrobiana. El sistema llegó en días a una conclusión que a los científicos del Imperial College London les llevó años de trabajo experimental.

Ese momento define algo nuevo: la IA no ya asiste a los científicos. Está comenzando a hacer ciencia.

Qué son AI Co-Scientist y AlphaEvolve

Son dos sistemas distintos pero complementarios lanzados por Google DeepMind en 2025. Ambos usan modelos Gemini como núcleo cognitivo. Ambos operan con bucles autónomos de generación, evaluación y refinamiento. Y ambos están produciendo resultados que eran impensables hace dos años.

AI Co-Scientist es un sistema multi-agente diseñado para ayudar a los científicos a generar hipótesis novedosas, planes de investigación y protocolos experimentales. Los investigadores especifican un objetivo de investigación en lenguaje natural —por ejemplo, entender mejor cómo se propaga un microorganismo causante de enfermedad— y el AI Co-Scientist propone hipótesis comprobables, junto con un resumen de la literatura publicada relevante y un posible enfoque experimental.

AlphaEvolve es un agente de código evolutivo diseñado para descubrir y optimizar algoritmos. Combina las capacidades creativas de resolución de problemas de los modelos Gemini con evaluadores automatizados que verifican las respuestas, y usa un marco evolutivo para mejorar las ideas más prometedoras. Su objetivo no es la hipótesis científica sino el algoritmo óptimo: el código más eficiente posible para un problema dado.

La arquitectura técnica: cómo funciona AI Co-Scientist

Dado un objetivo de investigación especificado en lenguaje natural, el AI Co-Scientist está diseñado para generar hipótesis de investigación novedosas, una descripción detallada de la investigación y protocolos experimentales. Para hacerlo, utiliza una coalición de agentes especializados — Generation, Reflection, Ranking, Evolution, Proximity y Meta-review — inspirados en el método científico mismo. Estos agentes usan retroalimentación automatizada para generar, evaluar y refinar hipótesis de forma iterativa, resultando en un ciclo autoajustable de outputs de calidad e innovación crecientes.

En detalle, cada agente tiene un rol distinto:

- Generation: genera las hipótesis iniciales a partir del objetivo del investigador y la literatura disponible

- Reflection: revisa críticamente las propuestas, identificando debilidades lógicas o vacíos en la evidencia

- Ranking: ordena las hipótesis por calidad mediante un sistema de torneos tipo Elo (el mismo usado en ajedrez competitivo)

- Evolution: toma las mejores hipótesis y las muta para generar versiones mejoradas

- Proximity: elimina ideas duplicadas o demasiado similares para mantener diversidad en el espacio de exploración

- Meta-review: sintetiza los resultados y produce el output final para el científico

El sistema usa un enfoque llamado test-time compute para generar hipótesis, una técnica que permite aumentar la calidad del output de un modelo de IA aumentando el tiempo e infraestructura que invierte en generar respuestas. A más compute invertido en tiempo de inferencia, mejor calidad de las hipótesis generadas.

El proceso completo es un ciclo «generate, debate, and evolve» que replica formalmente la estructura del método científico, pero ejecutado por una coalición de agentes especializados operando en paralelo y de forma asíncrona.

La arquitectura técnica: cómo funciona AlphaEvolve

AlphaEvolve opera sobre un principio diferente: evolución darwiniana aplicada al código.

El usuario define una especificación del problema, la lógica de evaluación (para medir qué tan bien funciona una solución propuesta) y un programa de inicialización semilla. La semilla es un fragmento de código compilable que ya resuelve el problema, aunque de forma subóptima. Los modelos Gemini procesan el contexto y generan versiones mutadas y optimizadas del código que se agregan al «espacio de población». Los algoritmos de evolución seleccionan cuáles de las mutaciones combinar y mutar aún más, priorizándolas como punto de partida para la próxima generación. Los resultados de la evaluación son usados por el ensemble de LLMs para generar el siguiente conjunto de soluciones mejoradas.

AlphaEvolve emplea un ensemble de modelos de lenguaje: una combinación de Gemini 2.0 Flash y Gemini 2.0 Pro. Este enfoque permite balancear el throughput computacional con la calidad de las soluciones generadas. Gemini 2.0 Flash, con su menor latencia, permite una mayor tasa de generación de candidatos, aumentando el número de ideas exploradas por unidad de tiempo. Gemini 2.0 Pro, con mayor capacidad, aporta sugerencias ocasionales de mayor calidad que pueden avanzar significativamente la búsqueda evolutiva.

La clave del sistema es la separación entre generación y verificación: el evaluador es definido por el usuario y mide el rendimiento real del código, no la plausibilidad verbal de la propuesta. Esto reduce drásticamente el riesgo de alucinaciones.

Los resultados que cambian todo: datos concretos

AI Co-Scientist: tres validaciones biomédicas

1. Leucemia mieloide aguda (AML): el AI Co-Scientist propuso candidatos para reposicionamiento de drogas con hallazgos de validación prometedores, incluyendo candidatos para leucemia mieloide aguda que mostraron inhibición tumoral in vitro a concentraciones clínicamente aplicables.

2. Fibrosis hepática: dos de los tres medicamentos recomendados por el AI Co-Scientist que apuntaban a modificadores epigenómicos exhibieron actividad antifibrótica significativa. El sistema fue consultado sobre el rol de cambios epigenómicos en la fibrosis hepática, generó hipótesis testables y las priorizó para validación experimental. Los resultados fueron confirmados en organoides hepáticos humanos, modelos tridimensionales multicelulares que replican la estructura del hígado humano. Fuente del paper: biorxiv.org/content/10.1101/2025.04.29.651320

3. Resistencia antimicrobiana — el resultado más perturbador: el AI Co-Scientist recapituló un descubrimiento no publicado sobre cómo las islas cromosomales inducibles por fagos formadoras de cápsides se propagan entre múltiples especies bacterianas — un mecanismo clave subyacente a la resistencia antimicrobiana. Según el paper de Gottweis et al., este resultado le tomó al sistema un par de días, mientras que el mismo hallazgo emergió de años de trabajo convencional de laboratorio.

En síntesis: en paralelo con investigadores del Imperial College London que trabajaban en el mismo problema, el AI Co-Scientist llegó a la misma hipótesis de forma independiente. No es que la IA encontró algo que los humanos no podían encontrar. Es que lo encontró órdenes de magnitud más rápido.

Paper original (arXiv): arxiv.org/abs/2502.18864 Blog de Google Research: research.google/blog/accelerating-scientific-breakthroughs-with-an-ai-co-scientist

AlphaEvolve: cinco métricas de impacto real

1. Algoritmo de 56 años superado: AlphaEvolve desarrolló un procedimiento de optimización basado en gradientes que descubrió múltiples nuevos algoritmos para multiplicación de matrices. Una de sus descobiertas mejoró el algoritmo de Strassen de 1969 — el mejor conocido para multiplicar matrices 4×4 de valores complejos usando 48 multiplicaciones escalares, la primera mejora tras 56 años.

2. Optimización de data centers de Google: un algoritmo descubierto por AlphaEvolve lleva más de un año impulsando Borg, el sistema masivo de gestión de clusters de Google, recuperando en promedio 0,7% de los recursos de cómputo globales de Google de forma continua. A escala de Google, eso equivale a millones de dólares en capacidad recuperada diariamente.

3. Aceleración del entrenamiento de Gemini: AlphaEvolve aceleró en 23% un kernel vital en la arquitectura de Gemini, lo que llevó a una reducción del 1% en el tiempo de entrenamiento de Gemini.

4. Diseño de chips TPU: AlphaEvolve propuso una reescritura en Verilog que removió bits innecesarios en un circuito aritmético clave y altamente optimizado para multiplicación de matrices. Esta propuesta fue integrada en un próximo Tensor Processing Unit (TPU), el acelerador de IA personalizado de Google.

5. Problemas matemáticos abiertos: cuando se aplicó a más de 50 problemas abiertos en análisis matemático, geometría, combinatoria y teoría de números, AlphaEvolve redescubrió soluciones de vanguardia en aproximadamente el 75% de los casos. En el 20% de los casos, mejoró las mejores soluciones conocidas.

Paper técnico (arXiv): arxiv.org/abs/2506.13131 Blog de Google DeepMind: deepmind.google/blog/alphaevolve-a-gemini-powered-coding-agent-for-designing-advanced-algorithms

El ecosistema más amplio: Genesis Mission y los 17 laboratorios nacionales

El impacto de estas herramientas no es solo académico. Google DeepMind proveerá un programa de acceso acelerado para científicos de los 17 Laboratorios Nacionales del Departamento de Energía de EE.UU. a sus modelos de IA de frontera y herramientas agénticas para ciencia. El AI Co-Scientist es un colaborador virtual multi-agente construido sobre Gemini, diseñado para ayudar a los científicos a sintetizar grandes cantidades de información para generar hipótesis y propuestas de investigación novedosas, acelerando el ritmo de descubrimientos científicos y biomédicos.

La Casa Blanca encuadra esto bajo la Genesis Mission: el objetivo de duplicar la productividad científica de Estados Unidos dentro de la década mediante IA. El AI Co-Scientist puede acelerar el desarrollo de hipótesis de años a días.

Cómo hacer una prueba: guía práctica para acceder hoy

AI Co-Scientist

Estado actual: disponible en acceso temprano a través del Trusted Tester Program de Google.

Cómo solicitar acceso:

- Ir a la página oficial: research.google/blog/accelerating-scientific-breakthroughs-with-an-ai-co-scientist

- Completar el formulario de acceso al Trusted Tester Program

- El sistema da prioridad a investigadores en biomedicina, química y ciencias de la vida

Qué necesitás para probar el sistema:

- Una cuenta de Google Workspace o institucional

- Un objetivo de investigación claro expresado en lenguaje natural (ejemplo: «entender por qué X bacteria desarrolla resistencia a Y antibiótico»)

- Acceso a literatura científica relevante para que el sistema la indexe

- Disposición a validar las hipótesis generadas con un experto de dominio

Flujo de interacción básico:

- Especificás tu objetivo de investigación en lenguaje natural

- El sistema genera un plan de investigación inicial con hipótesis ordenadas por relevancia

- Podés iterar: rechazar hipótesis débiles, pedir profundización en una específica, solicitar protocolos experimentales

- El sistema mejora sus propuestas en cada iteración mediante el bucle de torneo Elo

AlphaEvolve

Estado actual: disponible en private preview en Google Cloud para empresas, con acceso temprano para investigadores académicos.

Cómo solicitar acceso académico:

- Formulario de acceso anticipado: cloud.google.com/blog/products/ai-machine-learning/alphaevolve-on-google-cloud

- También mencionado en el paper arXiv: académicos pueden aplicar directamente

Qué necesitás para correr AlphaEvolve:

- Un problema de optimización cuya solución pueda expresarse como código ejecutable

- Una función de evaluación que mide el rendimiento (runtime, uso de memoria, precisión numérica, o métricas de dominio específico)

- Un programa semilla que ya resuelve el problema, aunque subóptimamente

- Acceso a la API de AlphaEvolve en Google Cloud (en preview)

Ejemplo de problema apto para AlphaEvolve: Tenés un algoritmo de ruteo logístico que tarda 200ms por consulta. Definís tu función evaluadora como «minimizar tiempo de ejecución manteniendo precisión >99%». AlphaEvolve genera variantes del código, las evalúa automáticamente y evoluciona las mejores hacia versiones cada vez más eficientes.

Herramientas alternativas de acceso abierto para experimentar con el paradigma:

- FunSearch (Google DeepMind, open source): el predecesor de AlphaEvolve, disponible públicamente en github.com/google-deepmind/funsearch. Genera funciones en Python para resolver problemas de búsqueda combinatoria.

- OpenHands / SWE-agent: frameworks open source para agentes de código con capacidades similares a menor escala.

- LangGraph + Gemini API: podés construir un pipeline multi-agente propio que replica la lógica de «generate, reflect, rank» del AI Co-Scientist usando la API pública de Gemini y LangGraph como orquestador.

Qué distingue este paradigma de los LLMs convencionales

La diferencia no es solo cuantitativa. Es arquitectónica.

Un LLM convencional recibe un prompt y genera una respuesta en un solo paso. No verifica su propia respuesta. No itera. No tiene memoria de sus errores anteriores. No compite sus propias hipótesis entre sí.

El AI Co-Scientist y AlphaEvolve operan en bucles: generan, evalúan, seleccionan, mutan, evalúan de nuevo. Gemini Deep Think actúa como «multiplicador de fuerza» del intelecto humano, manejando la recuperación de conocimiento y la verificación rigurosa para que los científicos puedan enfocarse en la profundidad conceptual y la dirección creativa.

La evaluación automatizada es clave. En AlphaEvolve, el código que no funciona mejor es simplemente descartado por el evaluador, sin que ningún humano tenga que revisarlo. En AI Co-Scientist, las hipótesis compiten en torneos donde son juzgadas por criterios formalizados de novedad, plausibilidad y relevancia experimental.

Esto convierte a la IA de un oráculo que responde preguntas en un sistema que formula preguntas, las testea y descarta las malas sin intervención humana.

Las implicancias y los límites honestos

Ninguno de estos sistemas opera en el vacío ni reemplaza al científico. AI Co-Scientist es una herramienta colaborativa para ayudar a los expertos a reunir investigación y refinar su trabajo — no está diseñada para automatizar el proceso científico.

Los límites reales son tres:

Validación experimental sigue siendo humana. El sistema genera hipótesis; los laboratorios las prueban. La brecha entre propuesta in silico y confirmación in vivo sigue siendo trabajo científico duro. AlphaEvolve reduce el espacio de búsqueda; no elimina la necesidad de ingenieros que entiendan los resultados.

Dependencia de la calidad del input. El AI Co-Scientist es tan bueno como la literatura científica que procesa y la claridad del objetivo que el investigador especifica. Objetivos vagos producen hipótesis vagas.

Riesgos de sesgos en la literatura. Si la IA es entrenada sobre literatura con sesgos de publicación (donde los resultados negativos no se publican), sus hipótesis heredarán esos sesgos.

Conclusión

El AI Co-Scientist y AlphaEvolve no son herramientas de productividad. Son una nueva clase de agente científico que opera dentro del método científico, no solo alrededor de él. Estas herramientas abren la puerta a un futuro donde cada científico en un laboratorio tiene un equipo de asistentes de IA investigando simultáneamente miles de soluciones potenciales a los desafíos que motivan su trabajo.

El algoritmo de Strassen resistió 56 años sin mejoras. La resistencia antimicrobiana tardó años en ser elucidada en el laboratorio. La fibrosis hepática no tenía blancos terapéuticos evidentes. En los tres casos, un agente que genera, evalúa y refina sin descanso llegó más lejos, más rápido.

La pregunta ya no es si la IA puede hacer ciencia. Es cómo vamos a integrar estos sistemas en la práctica científica sin perder el escepticismo, la verificación rigurosa y el juicio experto que hacen confiable al conocimiento científico.

Fuentes y recursos esenciales

Papers originales:

- «Towards an AI co-scientist» (Gottweis et al., 2025) — arXiv: https://arxiv.org/abs/2502.18864

- «AlphaEvolve: A coding agent for scientific and algorithmic discovery» — arXiv: https://arxiv.org/abs/2506.13131

- «AI-Assisted Drug Re-Purposing for Human Liver Fibrosis» — biorXiv: https://www.biorxiv.org/content/10.1101/2025.04.29.651320v1

Blogs oficiales de Google:

- AI Co-Scientist (Google Research): https://research.google/blog/accelerating-scientific-breakthroughs-with-an-ai-co-scientist/

- AlphaEvolve (Google DeepMind): https://deepmind.google/blog/alphaevolve-a-gemini-powered-coding-agent-for-designing-advanced-algorithms/

- Gemini Deep Think para ciencia: https://deepmind.google/blog/accelerating-mathematical-and-scientific-discovery-with-gemini-deep-think/

- Google Research 2025 — Breakthroughs: https://research.google/blog/google-research-2025-bolder-breakthroughs-bigger-impact/

Genesis Mission y Laboratorios Nacionales:

- Google DeepMind + DOE: https://deepmind.google/blog/google-deepmind-supports-us-department-of-energy-on-genesis/

- Google Cloud Genesis: https://cloud.google.com/blog/topics/public-sector/how-google-public-sector-and-google-deepmind-can-power-the-genesis-mission-and-a-new-era-of-scientific-discovery

Acceso y pruebas:

- AlphaEvolve en Google Cloud (private preview): https://cloud.google.com/blog/products/ai-machine-learning/alphaevolve-on-google-cloud

- FunSearch (open source, predecesor de AlphaEvolve): https://github.com/google-deepmind/funsearch

Análisis y cobertura:

- VentureBeat — AlphaEvolve: https://venturebeat.com/ai/meet-alphaevolve-the-google-ai-that-writes-its-own-code-and-just-saved-millions-in-computing-costs

- SiliconANGLE — AI Co-Scientist: https://siliconangle.com/2025/02/19/google-researchers-develop-ai-co-scientist-based-gemini-2-0/

- R&D World — Hypothesis generation timelines: https://www.rdworldonline.com/google-ai-co-scientist-can-reduce-early-hypothesis-generation-from-weeks-to-days-in-some-cases/

- MarkTechPost — AlphaEvolve técnico: https://www.marktechpost.com/2025/05/14/google-deepmind-introduces-alphaevolve-a-gemini-powered-coding-ai-agent-for-algorithm-discovery-and-scientific-optimization/

IA Autoreplicante vs. IA Evolutiva: cuando la máquina se reproduce y cuando se transforma

La Inteligencia Artificial Evolutiva (IAE) -AGI003

Agentes de IA Autoreplicantes: La Frontera Más Inquietante de la Inteligencia Artificial

CRISPR Parte I: Avances en Terapias Génicas con CRISPR para 2025 – Transformando la Medicina

¡El Futuro es Ahora! Los Avances Más Impactantes en Hologramas para 2025

Vercel: La Plataforma Líder en Desarrollo Web y AI Cloud

Coinbase lanza Agentic Wallets: las primeras billeteras diseñadas específicamente para agentes de IA autónomos

Solana prepara Alpenglow: el nuevo protocolo de consenso que revolucionará la blockchain en 2026

Primer workshop L1-zkEVM -ETHEREUM

TENDENCIAS

-

Bio12 meses ago

Bio12 meses agoCRISPR Parte I: Avances en Terapias Génicas con CRISPR para 2025 – Transformando la Medicina

-

Researchland12 meses ago

Researchland12 meses ago¡El Futuro es Ahora! Los Avances Más Impactantes en Hologramas para 2025

-

EmpresasTech4 meses ago

EmpresasTech4 meses agoVercel: La Plataforma Líder en Desarrollo Web y AI Cloud

-

AI12 meses ago

AI12 meses ago¿Qué es Hugging Face? Guía Actualizada a Mayo 2025

-

Nano1 año ago

Nano1 año agoLas últimas innovaciones en nanotecnología

-

AI5 meses ago

AI5 meses agoGoogle Antigravity: La Herramienta IA Multiagentes que Revoluciona el Desarrollo de Software

-

AI1 año ago

AI1 año agoAgentes de IA y Workflows Agénticos: La Revolución de la Automatización

-

AI1 año ago

AI1 año agoAgentes de IA vs. Agentic AI : Diferencias, Ejemplos y Avances Recientes