El momento que cambió el paradigma del software empresarial

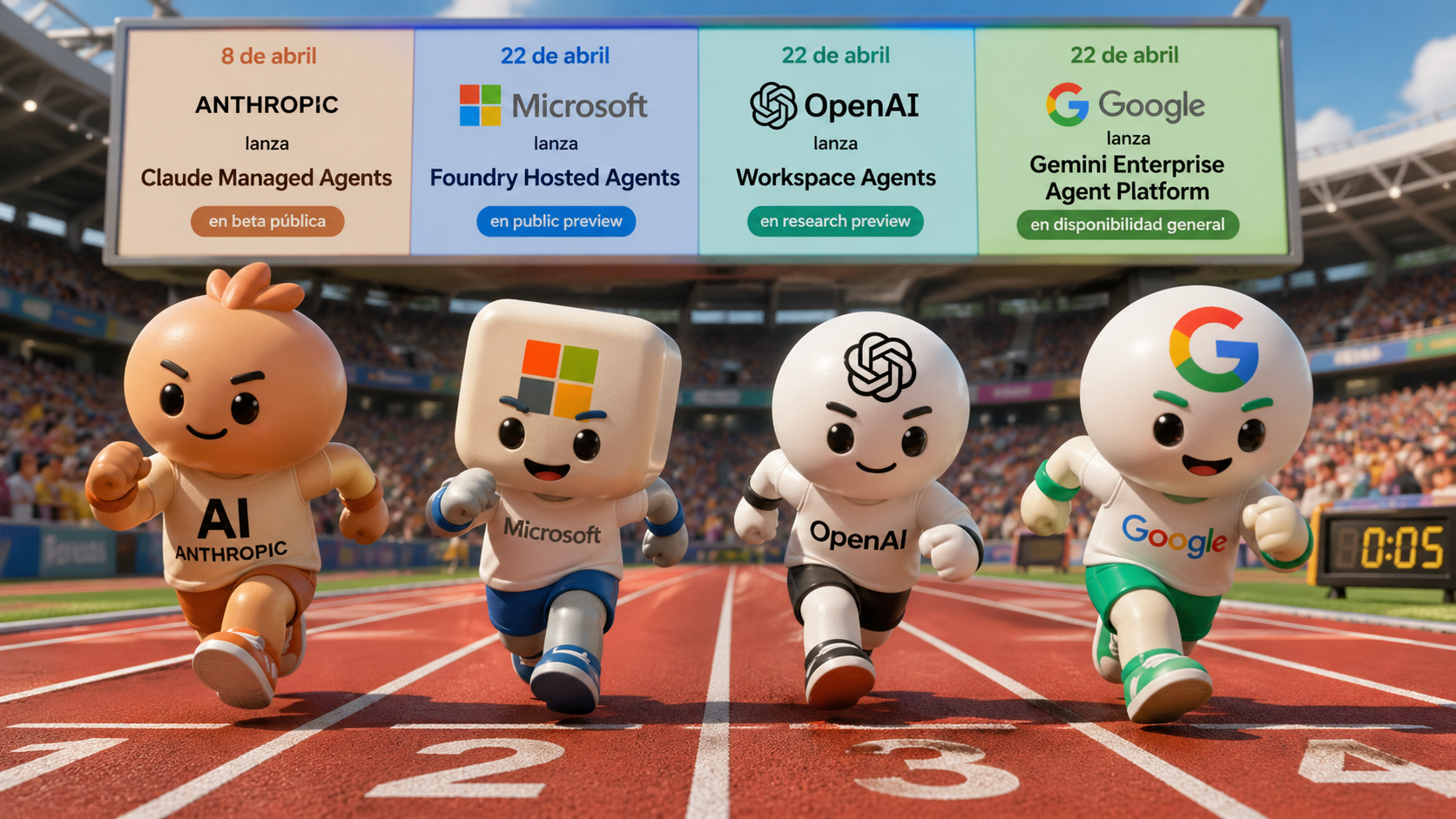

Durante años, los agentes de IA fueron territorio de demos y laboratorios. La semana del 21 de abril de 2026 fue la semana en que dejaron de serlo. En el lapso de 72 horas, las cuatro compañías más importantes del ecosistema de IA lanzaron plataformas de producción para desplegar agentes autónomos a escala empresarial.

El detonante fue Google Cloud Next ’26 en Las Vegas, que concentró los anuncios del 22 de abril. Pero la historia empieza dos semanas antes, el 8 de abril, cuando Anthropic silenciosamente puso en beta pública su infraestructura de agentes gestionados. La sincronía —real o estratégica— produjo lo que los analistas ya bautizaron como la «fiebre agéntica» más intensa de la historia del software.

Cronología:

- 8 de abril — Anthropic lanza Claude Managed Agents en beta pública

- 22 de abril — Microsoft lanza Foundry Hosted Agents en public preview

- 22 de abril — OpenAI lanza Workspace Agents en research preview

- 22 de abril — Google lanza Gemini Enterprise Agent Platform en disponibilidad general

Anthropic — El primer movimiento

Claude Managed Agents no es simplemente una API: es un runtime gestionado completo donde Claude opera como agente autónomo sin que el desarrollador tenga que construir la infraestructura subyacente. Anthropic fue la primera en mover ficha, el 8 de abril, con adopción temprana de Notion, Rakuten y Sentry.

Arquitectura técnica. La plataforma se basa en tres primitivas composables. La primera es la definición del agente: modelo, system prompt, tools, servidores MCP y skills. La segunda es la configuración del entorno: un container cloud con paquetes preinstalados, reglas de red y archivos montados. La tercera es el runtime de sesión: streaming via Server-Sent Events, historial de eventos persistido del lado servidor y ejecución de herramientas en sandbox aislado.

El acceso requiere el beta header managed-agents-2026-04-01. El pricing tiene dos dimensiones: las tarifas normales de tokens del modelo Claude más $0.08 por session-hora mientras la sesión está en estado activo, medido al milisegundo. Los rate limits son 60 requests por minuto en el endpoint de creación y 600 en lectura.

Capacidades en producción vs. research preview. Es importante distinguir lo disponible hoy de lo que está en acceso restringido. En beta pública ya funciona: sandboxed execution, checkpointing, credential management, scoped permissions y tracing end-to-end. En research preview, con acceso separado, están las dos capacidades más potentes: multi-agent coordination (agentes que coordinan sub-agentes para paralelizar trabajo complejo) y self-evaluation con outcomes definidos (el agente itera hasta cumplir criterios de éxito que vos definís).

En pruebas internas sobre generación de archivos estructurados, Managed Agents mejoró el task success rate hasta 10 puntos porcentuales sobre un loop de prompting estándar. Las mayores ganancias se registraron en las tareas más complejas.

OpenAI — El sucesor de los GPTs

OpenAI da muerte programada a los custom GPTs y presenta sus herederos: los Workspace Agents. El cambio de nombre no es cosmético. Los GPTs eran asistentes de sesión. Los Workspace Agents son trabajadores persistentes compartidos en la organización.

El motor: Codex. Los Workspace Agents corren sobre Codex, el runtime agéntico que OpenAI ha expandido agresivamente en 2026. Esto les otorga capacidades que los GPTs nunca tuvieron: ejecución de código nativa, manejo de archivos, memoria persistente, generación de imágenes, búsqueda web y programación de trabajo futuro. El agente puede despertar solo para continuar tareas días después de haber sido invocado.

Al lanzamiento, el producto incluye integración directa con Slack, Google Workspace (Gmail, Drive, Calendar, Docs, Sheets) y Salesforce, más más de 90 plugins que cubren herramientas como Atlassian Rovo, CircleCI, GitLab, Microsoft Suite, Neon by Databricks y Render. La integración con Slack es la más promovida: el agente vive dentro de un canal, responde a menciones, sigue hilos y toma ownership de tickets sin que el equipo tenga que cambiar su herramienta de trabajo diaria.

El sistema de Skills. Una de las innovaciones técnicas más relevantes es el mecanismo de Skills: módulos de instrucciones, recursos y scripts que garantizan outputs consistentes. Las Skills se construyen sobre el estándar open-source agent skills, lo que en teoría las hace interoperables entre plataformas de IA. El workflow es: definís la skill una vez, la asociás al agente, y el agente la aplica cada vez que enfrenta ese tipo de tarea.

Disponibilidad y pricing. Disponible en research preview para planes ChatGPT Business, Enterprise, Edu y Teachers. Gratis hasta el 6 de mayo de 2026, fecha en que comienza el modelo basado en créditos, donde cada ejecución consume créditos en proporción a la complejidad de la tarea, las herramientas llamadas y el tiempo de ejecución. Los planes Plus, Free y Consumer están excluidos del rollout inicial.

Google — La plataforma del desarrollador

Google hizo la jugada más ambiciosa de la semana: deprecó la marca Vertex AI como roadmap independiente y absorbió todo dentro de Gemini Enterprise Agent Platform. A partir de ahora, toda evolución de su stack de IA se libera bajo este paraguas. Es un replanteo completo de su propuesta de valor empresarial.

ADK: el framework de sub-agentes en grafo. El Agent Development Kit recibió su actualización más importante. En lugar de una cadena lineal de agentes, el nuevo ADK permite organizar agentes en redes de sub-agentes con arquitectura de grafo. Los agentes se ramifican, se coordinan y resuelven subproblemas en paralelo con lógica de flujo definida explícitamente. Más de seis trillones de tokens se procesan mensualmente sobre modelos Gemini a través del ADK.

Agent Runtime: sandboxes GKE con gVisor. La infraestructura de ejecución usa GKE Agent Sandbox con aislamiento de gVisor (trusted isolation). Las métricas publicadas son hasta 300 sandboxes por segundo por cluster, con 30% mejor price-performance que competidores en cargas AI. Los workspaces de agente son secure-by-design: entornos hardened para ejecutar comandos bash y gestionar archivos, completamente aislados de los sistemas core de la organización.

Dos capas diferenciadas. Google separa explícitamente dos audiencias. El Agent Platform está dirigido a equipos técnicos: construir, orquestar y gobernar con ADK, APIs y DevOps agéntico. El Gemini Enterprise App está dirigido a knowledge workers: crear agentes con lenguaje natural o interfaz visual, gestionar una bandeja de entrada unificada de tareas asíncronas largas, y colaborar en tiempo real con agentes en espacios de trabajo compartidos llamados Projects.

Model Garden y la apuesta por openness. Con más de 200 modelos disponibles incluyendo Gemini 3.1 Pro, Gemma 4, Claude Opus 4.7 de Anthropic, Llama y otros modelos open-source, Google apuesta por ser la infraestructura neutral. La decisión de incluir modelos de un competidor directo es la señal más clara de que la plataforma prioriza apertura frente al ecosistema cerrado. Además, Google comprometió $750 millones en fondos para acelerar la adopción agéntica en su ecosistema de partners.

Microsoft — El runtime para developers

Microsoft jugó la carta del desarrollador pragmático. Foundry no es una plataforma que te dice qué modelo usar ni qué framework elegir. Es la infraestructura que corre lo que vos ya escribiste, a escala empresarial. El lema implícito: trae lo que tengas.

Aislamiento de hipervisor, no de proceso. La diferenciación técnica más importante frente a la competencia es el nivel de aislamiento. Cada sesión de agente corre en su propio VM aislado a nivel de hipervisor, no en un container ni en aislamiento de proceso. Esto es production-grade hypervisor isolation a escala de cloud, con sistema de archivos persistente por sesión y tiempos de startup predecibles. Microsoft lo distingue explícitamente: no es aislamiento de proceso limitado, es aislamiento de hipervisor completo.

Multi-framework y multi-modelo por diseño. Foundry soporta LangGraph, Microsoft Agent Framework, OpenAI Agents SDK, Claude Agent SDK y GitHub Copilot SDK. En cuanto a modelos, corre OpenAI, Anthropic, Meta, Mistral, DeepSeek, xAI y más. Un agente puede usar DeepSeek para planificación y un modelo de OpenAI para generación, con LangGraph como orquestador. El runtime maneja la capa de consistencia.

Toolbox: el endpoint MCP unificado. Uno de los problemas más costosos en producción agéntica es que cada equipo reimplementa las mismas integraciones. Toolbox lo resuelve con un endpoint MCP único: definís la herramienta una vez, cualquier cliente MCP se conecta al mismo endpoint. Auth handling, OAuth identity passthrough y observabilidad por tool call están incluidos por defecto, eliminando la duplicación de credenciales y configuraciones.

Pricing. El compute se cobra a $0.0994 por vCPU-hora y $0.0118 por GiB-hora, únicamente durante ejecución activa. La memoria a largo plazo es gratuita durante el preview hasta el 1 de junio de 2026, fecha en que pasa a $0.25 por cada mil eventos almacenados. El deploy se hace con un solo comando (azd deploy) desde cualquier Dockerfile.

Microsoft Agent Framework v1.0 y Agent 365. El mismo día se publicó MAF v1.0, la versión estable que unifica Semantic Kernel y AutoGen en un solo framework de producción. Y se anunció para el 1 de mayo Agent 365: el panel de control para que los equipos de IT administren todos los agentes del tenant en una sola vista, a $15 por usuario por mes.

Los protocolos que unifican la capa agéntica

Detrás de todos los anuncios aparecen dos protocolos en cada stack. MCP (Model Context Protocol), de origen en Anthropic, define cómo los agentes se conectan a herramientas y fuentes de datos externas. A2A (Agent-to-Agent), propuesto por Google, define cómo los agentes se comunican entre sí cuando pertenecen a diferentes plataformas.

Microsoft adoptó MCP en Foundry Toolbox. Google soporta ambos en Agent Platform. OpenAI usa su propio sistema de Skills pero lo declara interoperable con el open-source agent skills standard. La emergencia de protocolos compartidos es la señal más importante de madurez del ecosistema: la plataforma de ejecución puede ser propietaria, pero la capa de integración tiende hacia estándares abiertos.

Análisis: cuatro ángulos distintos para el mismo problema

Anthropic apuesta a que modelo e infraestructura co-diseñados producen mejores resultados agénticos. La mejora de hasta 10 puntos en task success no viene del modelo solo: viene de que el harness está optimizado para cómo Claude razona sobre herramientas y se recupera de errores.

OpenAI apuesta a la distribución. El mayor activo de Workspace Agents no es técnico: es que vive dentro de ChatGPT, donde ya están millones de usuarios empresariales. La integración con Slack es el caballo de Troya: el agente no requiere que la organización cambie cómo trabaja.

Google apuesta por convertirse en infraestructura neutral. Incluir modelos de Anthropic, Meta y otros, y soportar protocolos abiertos como MCP y A2A, es una estrategia de largo plazo. La arquitectura de sub-agentes en grafo del ADK es técnicamente la más sofisticada para workflows complejos.

Microsoft apuesta al DevOps enterprise. El aislamiento de hipervisor por sesión resuelve el problema que tenían los equipos de seguridad para aprobar agentes en producción. Foundry no intenta ser la interfaz ni el proveedor de modelo: es la infraestructura sobre la que corre lo que ya existe.

La tensión central: lock-in vs. portabilidad. Managed Agents de Anthropic y Workspace Agents de OpenAI tienen mayor lock-in por diseño: el runtime es específico del proveedor. Foundry de Microsoft y Agent Platform de Google ofrecen mayor portabilidad de framework y modelo, pero el lock-in de infraestructura cloud persiste. Los protocolos abiertos son la respuesta del mercado a esta tensión.

El elefante en la sala. Las capacidades más potentes de cada plataforma —multi-agent coordination en Anthropic, self-evaluation en Managed Agents, sub-agentes en grafo en Google— están en research preview con acceso restringido. La «fiebre agéntica» de la semana del 22 de abril fue, en parte, marketing de roadmap. Los productos que están en disponibilidad general hoy son el piso, no el techo.

Conclusión

La semana del 22 de abril de 2026 no fue un accidente coordinado. Fue el resultado de que cuatro compañías llegaron al mismo punto de madurez técnica al mismo tiempo: los agentes de IA dejaron de ser prototipos de laboratorio y se convirtieron en infraestructura de producción con pricing, governance, aislamiento y observabilidad de nivel enterprise.

La carrera agéntica no se va a ganar con el mejor modelo. Se va a ganar con el mejor runtime: la plataforma que resuelva más completamente el problema de llevar un agente desde un notebook de desarrollo hasta producción a escala, con los controles de seguridad, compliance y trazabilidad que las organizaciones necesitan.

Anthropic arrancó primero. Google apostó más fuerte en infraestructura. Microsoft tiene la mejor historia de governance. OpenAI tiene la mayor distribución. Todos tienen piezas del puzzle. Ninguno lo tiene completo todavía.

La fiebre agéntica de abril de 2026 es el pistoletazo de salida, no la línea de llegada.

Fuentes: InfoWorld, VentureBeat, Google Cloud Blog, Microsoft Foundry Blog, Anthropic Platform Docs — Semana 21-26 Abr 2026

Bio12 meses ago

Bio12 meses ago

Researchland12 meses ago

Researchland12 meses ago

EmpresasTech4 meses ago

EmpresasTech4 meses ago

AI12 meses ago

AI12 meses ago

Nano1 año ago

Nano1 año ago

AI5 meses ago

AI5 meses ago

AI1 año ago

AI1 año ago

AI1 año ago

AI1 año ago